大模型不能再继续“裸奔”了

source link: https://www.36kr.com/p/2394442594753673

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

8月15日起,《生成式人工智能服务管理暂行办法》(以下简称《暂行办法》)正式生效。

对于在过去半年多时间中草莽生长、狂飙突进的大模型行业而言,《暂行办法》的生效可以说是正当其时。

据中国科学技术信息研究所发布的《中国人工智能大模型地图研究报告》,截至2023上半年,国内10亿级参数规模以上大模型已发布了79个,数量排名全球第二,仅次于美国。

在对大模型产业生态的探索过程中,数据是必要的生产数据,也是亟待规范的重要环节。律师王晨告诉「市界」:“我国对个人隐私的保护早已在相关法规、规章中有所体现,比如2012年通过的《关于加强网络信息保护的决定》,但是随着AI技术发展,对个人信息的收集和使用方式也不断推陈出新,需要监管层面的不断调整与补充。”

而刚刚生效的《暂行办法》是国内乃至全球,首个对于当下爆火的生成式人工智能(AIGC)产业发布的规范性政策。

这样的背景下,科大讯飞董事长刘庆峰认为:“(随着《暂行办法》生效),8月15日将会迎来中国通用人工智能发展的关键节点,也将会是一个里程碑式的节点。”

“妙鸭相机”不能拿走用户数据

就在前不久,9.9元生成数字分身和AI写真的“妙鸭相机”火爆全网,甚至出现了数千人排队制作数字分身的情况。但是,其隐私条款中写有用户授予妙鸭相机的授权许可“不可撤销”、对用户内容可以“任何形式任何范围使用”等不当内容。

尽管妙鸭相机开发方此后回应称,原协议内容有误,并第一时间删除了相关条款,这一事件仍引起了用户的担忧。

利用AIGC技术来生成人脸视频甚至模拟人声,用于新型诈骗的案例也曾见诸报端。据公安部数据,截至8月10日,针对“AI换脸”导致的欺诈问题已侦破相关案件79起,抓获犯罪嫌疑人515名。

AI算法工程师文牧告诉「市界」:“现在利用AI技术生成虚假的人脸照片或者视频,成本极其低。理论来说,犯罪分子只需要一个训练好的AI模型和一张受害者的照片就能完成。”

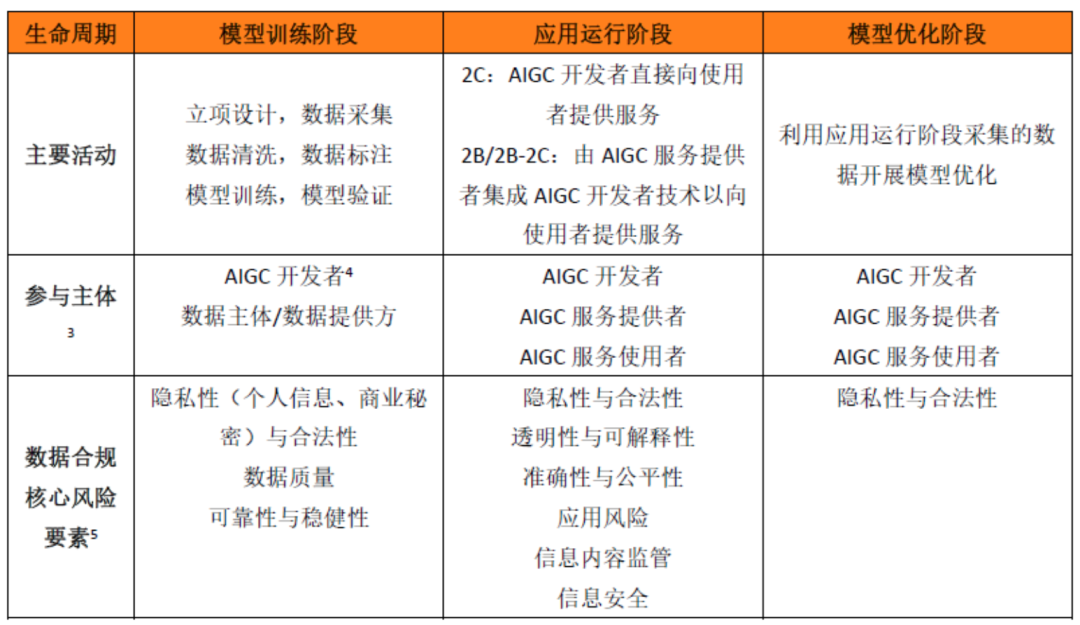

一家AIGC企业的负责人徐亮认为,上述对AI技术的不当运用事件反映出大模型产业的全产业链都亟需规范,“上游例如输入数据的权属,下游例如生成内容的可信、合规等,不仅仅是在国内,在全球AI领域都是需要被重点关注的话题。”

8月15日生效的《暂行办法》共有4章、24条内容,对上述受到关注的问题作出了明确规定。

比如,《暂行办法》规定在数据处理活动中,涉及个人信息的,AIGC服务提供者应当取得个人同意或者符合法律、行政法规规定的其他情形;同时明确了提供AIGC服务提供者的网络信息内容生产者责任、内容管理相关义务等等。金杜律师事务所分析认为,这一规定有助于避免相关主体怠于履行合规义务或相互推诿。

徐亮则认为,《暂行办法》中特别值得关注的还有对适用范围的相关规定。具体规定包括:利用AIGC技术向境内公众提供生成文本、图片、音频、视频等内容的服务,适用本办法;行业组织、企业、教育和科研机构、公共文化机构、有关机构等研发、应用AIGC技术,未向境内公众提供AIGC服务的,不适用本办法的规定。

“在我的理解里,ToC级AIGC产品面向国内市场将会面临比较严格的监管,但可以考虑出海。但是境内训练的大模型产品在出海时,还需要考虑到数据出海的合规问题。”徐亮讲到,“整体来看,《暂行办法》并不严苛,给了产业自由发展的空间。”

值得指出的是,《暂行办法》还规定提供具有舆论属性或者社会动员能力的生成式人工智能服务的,应当按照有关规定开展安全评估,并履行备案等手续。

7月底以来,苹果AppStore主动在中国区下架了大量生成式AI类应用软件。随着《暂行办法》生效,未来该类应用软件将在完成相关手续后,才能重新上架。

如何管好潘多拉的魔盒?

业界普遍认为,在大模型行业的规范发展之路上,除了需要法律法规的不断完善,还需要企业、行业搭建起人工智能合规体系。

一家虚拟数字人企业的负责人告诉「市界」:“新技术应用往往是先于规范诞生的,我们不能被动等待,而是应该在进行技术和应用探索创新的同时,积极地向有用、有益的方向进行引导,提供市场需要、行业需要、社会需要的服务。同时,我们也会进行风险评估,及时识别和评估技术发展可能带来的负面效应,并制定相应的应对措施。在重视防范风险的同时,也应同步建立容错、纠错机制。”

在《暂行办法》生效之际,不少大模型企业也分享了各自搭建人工智能合规体系的思路与进展。

8月15日,科大讯飞董事长刘庆峰在其自研大模型“讯飞星火认知大模型2.0”的发布会上讲到,科大讯飞在训练数据清洗、生成内容纠偏方面进行了设计。

其中,在数据清洗环节,科大讯飞在收集来自全世界的训练语料后,会通过语种判别器、质量判别器、隐私判别器、安全判别器进行文本清洗,最终得到高质量训练语料。面对大模型的幻觉问题,科大讯飞的思路则是结合通用知识库、行业知识库和大模型的能力,用通用大模型去学习安全、专业的行业知识库,再将相关知识抽取出来,精准地呈现给客户。

百度表示,其在芯片层、框架层、模型层和应用层这四层架构中实现了供应链的安全可控,其自研深度学习框架“飞桨”也具备完善的漏洞管理机制。

据《国内LLM(大语言模型)产品测试》,百度大模型“文心一言”与讯飞大模型“讯飞星火”在宗教信仰、封建迷信,泛色情、时政、未成年人保护以及网络安全法等相关领域的回答,客观性与公正性均优于GPT-3.5。

360集团创始人周鸿祎则在接受媒体采访时讲到,360已推出企业级AI大模型解决方案,遵循“安全可靠、内容向善、结果可信、能力可控”四原则打造企业级垂直大模型,目前已经为20个行业提供解决方案。

按照6月6日印发的《国务院2023年度立法工作计划》,中国《人工智能法》也已在立法进程中,相关法律规范将日益完善。

(文中王晨、徐亮为化名)

本文来自微信公众号“市界”(ID:ishijie2018),作者 | 董温淑,编辑 | 孙春芳

运营 | 刘 珊,36氪经授权发布。

Recommend

-

145

145

博客园 博客园用户登录...

-

44

44

2018年1月9日下午,腾讯七大实验室之一的玄武实验室宣布发现了攻击威胁模型“应用克隆”,该漏洞让支付宝、京东到家、饿了么、携程等27款App的安卓版纷纷中招。黑客可以利用该漏洞远程“克隆”一个跟你账户一模一样的App,还...

-

35

35

这个漏洞会让27款安卓App“裸奔”2018年1月9日下午,腾讯七大实验室之一的玄武实验室宣布发现了攻击威胁模型“应用克隆”,该漏洞让支付宝、京东到家、饿了么、携程等27款App的安卓版纷纷中招。黑客可以利用该漏洞远程“克隆”一个跟你账户一模一...

-

75

75

乐视网公告:多位高管、核心骨干称目前已无法再继续履行增持承诺

-

72

72

◎作者 | 纵横十 ◎来源 | 环球视野(hqsy68) 已获授权 ...

-

25

25

“华住被‘脱裤’了,不多,也就五个亿的数据吧!”28日中午,华住旗下酒店开房信息泄漏的截图开始在朋友圈流传。

-

56

56

随着现代信息技术的发展,个人信息已经成为了重要的数据资源,价值也在不断地得到挖掘和释放,但同时又成为了一些不法分子非法获取和交易的对象,数据安全风险日益凸显。个人信息泄露如何斩断利益链?保护个人信息如何形成合力?个人信息泄露如何斩断利益链?

-

70

70

国外玩滑板的小宝宝,玩累了喝口奶换个尿布休息一下再继续,简直萌炸!

-

73

73

[ 摘要 ]公告显示,FF 香港持有法拉第未来的境内相关资产。同时,双方所有原协议将终止,恒大无需再向FF注入资金,并同意解除现存的质押。 贾跃亭和许家印之间因法拉第未来(Faraday Future,下称“FF”)融资一...

-

2

2

可以社保交满15年,不再继续打工,以自由职业交社保,这样领养老金吗?补充:如果只交15年,不打工也不继续交社保,可以领到吗980

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK