10分钟从老板手里骗走430万,骗子们是把AI玩明白了

source link: https://www.woshipm.com/ai/5831763.html

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

10分钟从老板手里骗走430万,骗子们是把AI玩明白了

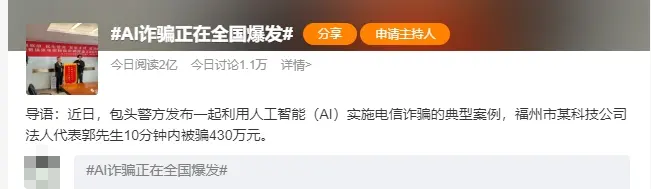

在 AI 技术的高速发展浪潮下,有些人可能会利用 AI 来实现业务提效,但部分用心不良的人却将 AI 技术用于诈骗, 比如近日,有关“AI 诈骗”的消息就登上了热搜,引起了不少人的关注和防范。那么我们如果看待“AI 诈骗”?一起来看看作者的分析。

AI工具还有很多人没用上呢, AI 诈骗它就来啦!

今天一个新闻上热搜了,内容是“AI 诈骗”。

这个热搜的词条,其实是有些夸大的,但里面实际发生的事儿,也的确离谱。

事情发生在福州,一位科技公司的老板,老郭,某天突然接到了个好友的微信视频,说是自己的朋友在外地竞标,需要 430万的保证金,想走他的公司账户过个账。

老郭想着也不是啥大事儿,于是在确认视频通话里的人和声音都是他朋友之后,就同意了。

随后,对方就给老郭发了一张银行卡转账成功的截图,说是钱已经转到老郭的户头上了。

由于老郭之前已经确认了朋友的身份,在没确认钱到帐与否的情况下,也没有多想,直接就把 430万转到了好友给的银行卡上。

整个过程不过短短十分钟……

转账完成之后,当老郭再次和好友打电话核实时,这才惊呼,刚才的一切,居然都是诈骗人员使用各种技术手段伪造的!

不仅好友视频的人像是 AI 生成的,就连好友的音频都是通过 AI 技术模拟的,好在警方跟银行通力合作,截停了钱在银行的走向,帮老郭止损了大部分损失。

你还别不信,现在的 AI 拟人和拟声都非常简单了,世超自己都能炼一个简单的出来。

还记得之前咱们使用 AI 拟声工具和 AI 视频工具模拟的数字人蛋蛋吗?(我司同事,差评视频内容的声音就是他录的)

这个数字人视频只使用了一张照片做素材,其中的动作和声音都是使用 AI 生成的。

整个视频制作训练花了不过数小时,而音频在训练完模型后推理的时间不超过五分钟……

可以说,在现在这个时代,不但是语音消息不保真了,这以后连视频通话见到真人都不能信了。

随后世超就把这个事发到群里和小伙伴们讨论了一下,大家聊了一下认为,这一整个案件里让人惊叹的,还不仅仅是AI伪造的视频和人声,细究下去,事件里的华点还真不少。

警方没有公布太多的细节,估计是太细了容易被别的骗子当教材学过去,但根据仅有的细节,我们能分析出几点:

- 诈骗团伙在给郭先生打视频电话时,使用的就是他好友的微信号,把他朋友的微信号盗了;

- 骗子掌握了比较多的郭先生朋友的图片、音视频信息,用来训练模型;

- 骗子拥有实时渲染数字人的技术,因为警方新闻中提到了郭先生和他朋友打的是微信视频;

- 骗子应该对郭先生及其朋友的过往对话风格有比较深入的了解,知道怎么跟郭先生沟通(微信是仅能云同步很有限的聊天记录的)。

以上所有的条件,无论哪一个,具体到实施上,都是很有难度的操作。

但,它却就这么真实的发生了。

世超专门找了几位信息安全从业者问了问,最后发现这个案子,还真的没那么简单。

首先是世超百思不得其解的微信登录问题。对于这点,各位大佬们都觉得这个其实不难,主要有两个方法能够做到。

一种方式是微信二维码钓鱼,另一种则是获取Session(可以简单理解成是cookie,能保持登录状态)。

微信二维码钓鱼这个不难理解,就是利用钓鱼网站或者链接,让受害者的朋友通过微信扫码登录电脑微信,这样诈骗人就可以用自己的设备使用他朋友的微信了。(不过其中一位老哥指出,微信异地扫码登录会触发风控)

第二种获取 Session ,只要受害者朋友的电脑上设置了微信自动登录,那只要获取相应的 Session ,理论上就能在诈骗人的电脑上登录受害者朋友的微信了。

不过出于安全考虑,咋获取这个 Session ,这位业内人士没细说。

对了,还有另外一种简单粗暴的方式,就是被盗号的人自己电脑是登录微信的,电脑处于开机状态,但是被骗子用木马远控了。

登录微信之后,接下来的操作才是重头戏。

诈骗人应该“蹲点”了很久,知道被盗号者微信上谁有钱谁没钱,跟谁关系好,事先挑好了下手对象。同时,骗子还对他的生活习惯非常了解,这样才能趁对方不注意登上他的微信,进行视频通话诈骗。

而想要在微信视频的同时 AI 换脸和变声,诈骗人员还得将摄像头和麦克风的数据,替换成 AI 换过脸和变过声的数据流。

至于训练素材,极有可能是通过被盗号者自己的朋友圈或者与别人的聊天记录获取。

最后,结合所有获取的信息,训练好素材,编造一个剧本来对受害者实施诈骗。

也就是说,这群诈骗人员,不仅有技术,耐心也不差。

在和这些信息安全的朋友一整个聊下来之后,世超是冒了一身冷汗。像这种诈骗,别说是家里的老人分辨不出来了,就算是神仙来了,都能给你晃迷糊。

不过朋友们还是给了大家一个安慰:像这次的诈骗事件,理论上技术可行,但终究还是一个小概率事件。

毕竟在这次的案件里,个人微信被盗用是更主要的原因,而这也是诈骗过程中需要花费最多功夫的步骤。假如没有这一步,受骗人必然会更加警惕,整个诈骗环节的漏洞也会更多。

想要让骗子花那么多精力来骗你,前提条件是你值得……

但是,高策划诈骗难度高,并不代表着低策划诈骗就骗不到人了。

使用 AI 诈骗的案件现在其实已经屡见不鲜了。

看看之前那个数字蛋蛋的制作过程就知道, AI 对于那些实施语音电信诈骗的人员来说,简直不要太高效。

而且类似的诈骗案件在国内国外也已经层出不穷了。

之前就有一个国外的诈骗公司,使用 AI 模拟了“卷福”的音频,打电话给一家新西班牙的小电影公司,称想要和对方合作,并要求对方先打款 20万英镑才能见面。

结果在电影公司付完钱之后,他们才发现这次事件,完完全全就是一场 AI 骗局……

这件事情让我们非常担心那些跟不上高速发展的科技的长辈们,他们可能很难相信正在跟自己视频通话的儿女是假的,骗子找他们要钱可能会轻松得手。。。

在音视频都不可信的情况下,以后或许要给父母一个密保问题了。可以告诉父母,万一微信自己找他们要钱,让他们问一些只有你们自己才知道的细节,比如:

“儿子,你小时候我经常用衣架打你还是拖鞋打你?”

这个问题最好也有陷阱,正确回答应该是“你用扫把打我”。

除了多提高防范意识、多给长辈们科普最新骗术,世超还是要啰嗦一下各位差友,咱们在对个人信息的敏感度上,还是得多上一点心。

之前我们在文章里提到“个人信息泄露”相关的新闻时,常常会有差友发表“完全不在意,反正底裤早都漏光了”的言论。

而且让我挠头的是,还有不少人,是认可这种躺平论的。

但你看,随着技术,特别是 AI 技术的爆发,个人信息泄露的危害已经开始显而易见地越来越大。大伙再这么躺,就纯纯是对骗子们的不尊重了。

到那时候,你泄露的个人的信息,指不定转头就把身边的人骗了,这该上哪说理去?

图片、资料来源:

- 10分钟被骗走 430万!小心这种新型诈骗手段!

作者:晚上吃早饭;编辑:江江 & 面线 & 大饼

来源公众号:差评(ID:chaping321),Debug the World。

本文由人人都是产品经理合作媒体 @差评 授权发布,未经许可,禁止转载。

题图来自 Unsplash,基于 CC0 协议。

该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK