直击OpenAI首次听证会:大模型研究不暂停,AI厂商可能要上牌照 | 焦点分析

source link: https://www.36kr.com/p/2261432832044934

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

文 | 邓咏仪 林炜鑫 周鑫雨

特邀作者 | 孙佳怡

编辑 | 苏建勋

“你同意开发人员拥有对技术所引发问题的豁免权吗?”一名议员提问。

“我不知道这个问题的正确答案。”思考了几秒后,Altman依然没能给出明确答案。

这是立法机构和AI企业首次同台交锋的一个切面——北京时间2023年5月16日,OpenAI 创始人兼CEO Sam Altman出席了美国国会召开的主题为“AI监管:人工智能的规则”的听证会。在美国国会大厦,这位风头正盛的创业者首次接受立法者的质询。

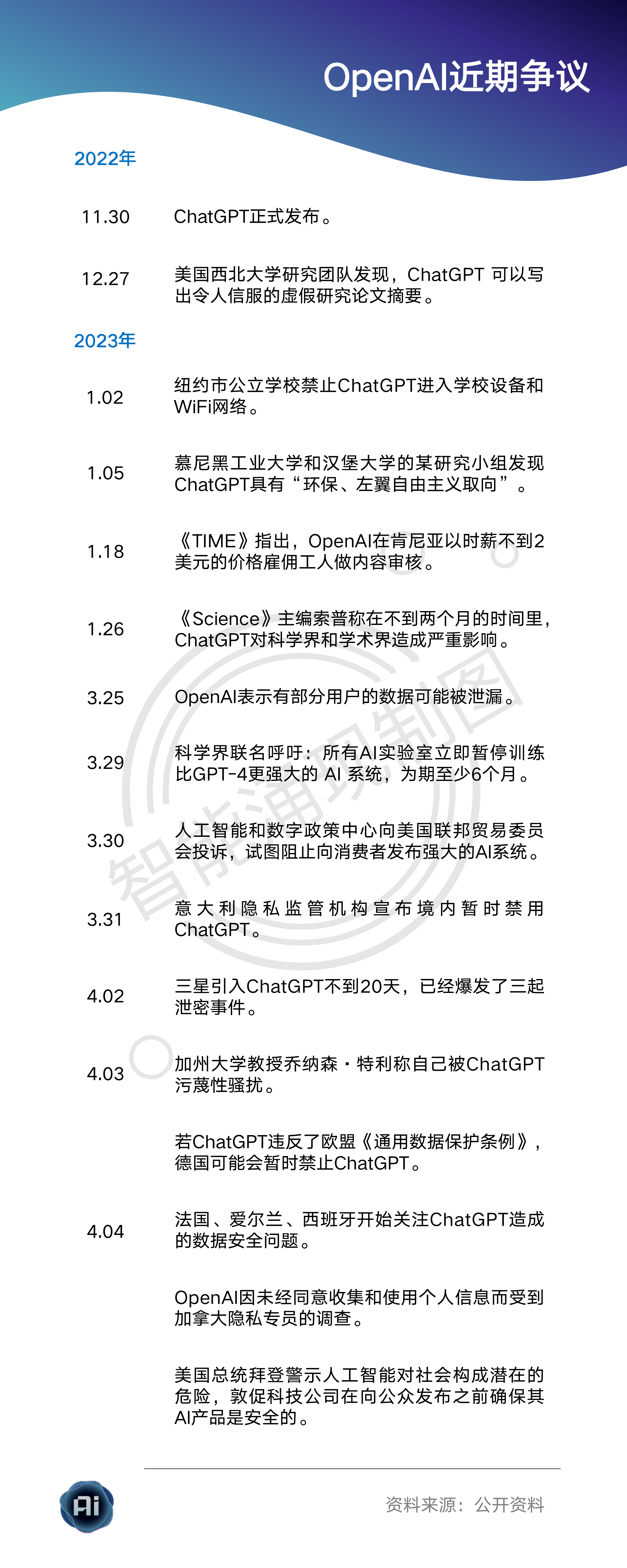

在经历ChatGPT推出、全球爆火,成为AI领域最炙手可热的公司后,这家年轻公司的另一面是面临来自美国监管机构、公众的数据、伦理争议——这也是监管机构召开此次会议,推进立法的原因。

制图:周鑫雨

这场持续近三小时的听证会,围绕着版权侵害、虚假内容、影响选举、数据安全、大公司垄断、政府监管途径等议题展开。接受质询的对象除了OpenAI CEO Sam Altman,还有IBM副总裁兼首席安全官Christina Montgomery,以及纽约大学教授Gary Marcus。后者以质疑当代AI技术而闻名。在叫停GPT-5的联名信中,Marcus也签下了自己的名字。

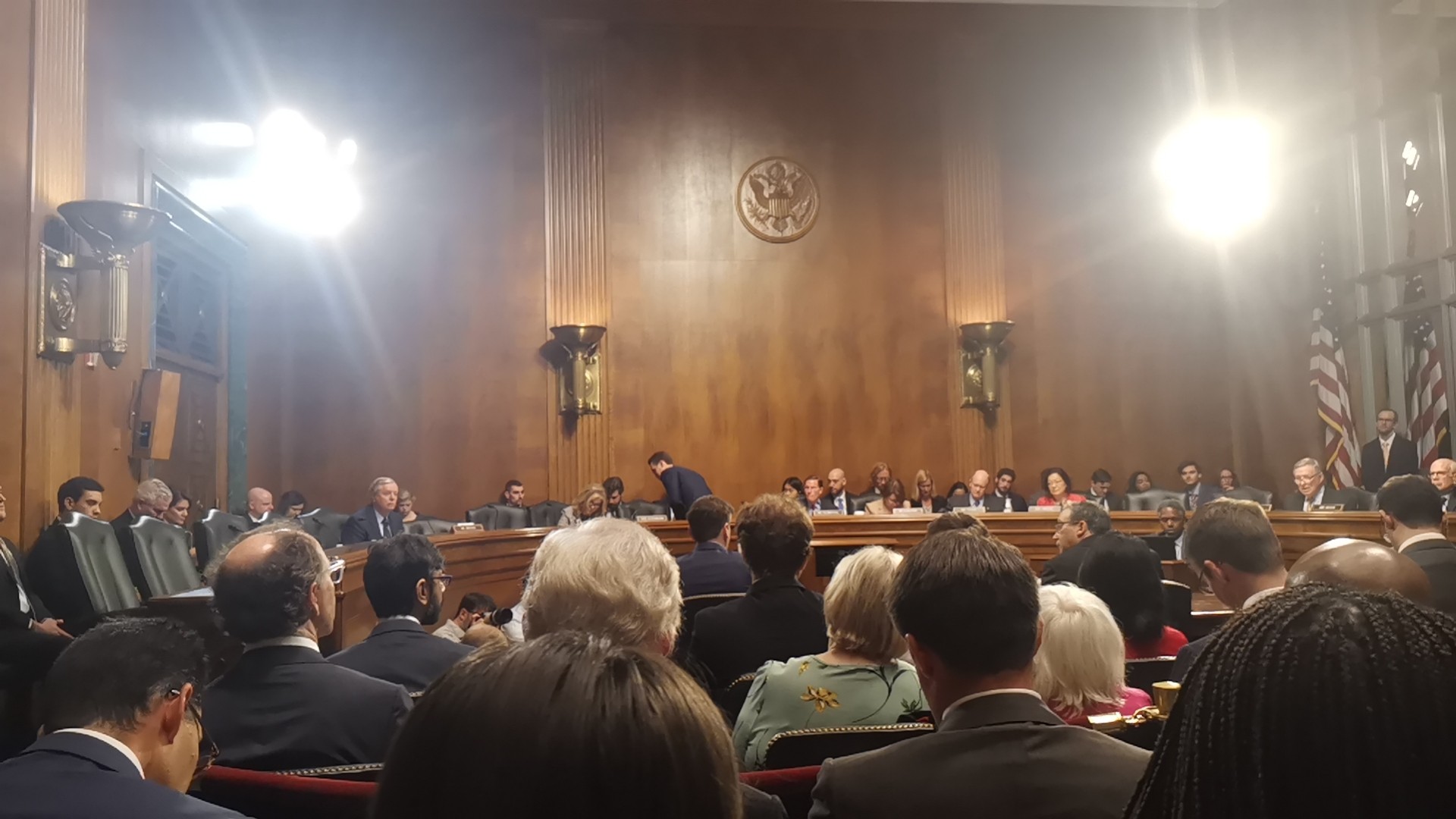

只是相较于在中美均引发高度关注的TikTok听证会,这场质询的热度并不高。听证会所在的226会议厅,大小只有TikTok听证会的一半,只能容纳大约30多人。直到开场,参与质询的议员也没有填满整个厅。当听证会进行到一半时,不少议员已经离席。

在大洋彼岸,中国AI厂商对这场听证会似乎也兴趣寥寥。百度的一位AI相关业务员工告诉36氪,这场听证会“不是找OpenAI算账”,而是推动监管,距离国内厂商的业务较为遥远。另一家互联网企业AI业务条线的员工表达了类似的观点:“按照目前国内的大模型能力和业务规模,即便出了海,都不足以让美国监管对其产生什么实质性影响。”

OpenAI听证会现场 拍摄:孙佳怡

纵观整场听证会,协商的意味远大于质询。参议院的大多问题不算尖锐,Altman的阐述极少被打断。相较于Meta创始人扎克伯格和TikTok CEO 周受资在听证会上的待遇,Altman显然要幸运得多。

过去一段时间,他四处奔走,希望让立法者更理解ChatGPT。5月初,他同谷歌、微软CEO一道去白宫参加哈里斯副总统的座谈会。听证会的前一天,Altman和大约60名众议院议员(两党各占一半)共进晚餐。知情者称,Altman在聚会上展示了ChatGPT的多种用途以吸引在场者,他们中的大多数认为AI监管很有必要。

外界只能通过5月9日的一场直播对谈,听到他针对AI的新一轮思考:后续AI行业会分化,开源模型负责解决大部分经济活动,闭源的超级智能则致力于更高的创新发明;AI监管需要建立类似保证核不扩散的原子能机构一样的国际组织,任何超出能力阀值的系统都要接受审核。

在这场听证会上,Altman对5月9日的观点进行了重申——他支持对AI监管,提议为AI厂商上牌照。与此同时,他强调AI的发展会创造更多就业岗位,以及未来引领技术创新的将会是大厂商,而非开源社区。

社交媒体监管失败后,国会欲提前夺回主导权

整场听证会中,包括主席以及及多位议员都强调的核心议题,是如何避免重蹈覆辙——自2016年以来,美国立法者们花了多年时间讨论如何监督社交媒体,却始终没有讨论出新的重要规则,导致错失了对Meta、Youtube等互联网巨头的多个监管节点。

比如听证会开幕致辞中被反复提及的“第230条”:1996年,美国国会通过《1996年通信规范法》230条款,旨在保护网络服务商免受用户帖子的责任。后续的发展证明,“第230条”是一把“双刃剑”:既促进了社交媒体的蓬勃发展,也为社交媒体的监管困难埋下伏笔。

因此,监管机构如今希望在AI领域的监管能够尽量前置。“当年,我们面对社交媒体时,我们有着一样的选择时点(指出手监管),但我们未能抓住这个机会,结果导致互联网中掠食者群起、有毒内容泛滥,”听证会主席Blumenthal在开场辞中表态,“如今我们有义务在AI领域阻止这些危险来临。”

议员们拿出社交媒体的几个老大难问题——用户隐私、创作者版权、未成年人保护等角度,轮番询问Altman Altman。

首先,Altman Altman数次否认OpenAI“是社交媒体”,对议员解释ChatGPT的运行原理,说明为什么ChatGPT与社交媒体不同。

比如,针对社交媒体为了抢夺人们注意力和成瘾问题,Altman Altman表示,OpenAI没有建立起基于广告的商业模式,所以也并不会建立起详细用户画像,吸引用户使用。“实际上,我们并不希望他们用得越多越好,相反,我们还希望他们用得少一点,因为我们的GPU不够了。”他说。

围绕个人隐私安全和版权保护等热门话题,议员们展开了密集的质疑。其中,虚假信息、数据来源是最受关注的一项——或许这与即将到来的2024年美国大选相关。议员们普遍担忧AI大模型相关技术将损害选举公正性、操纵舆论,制造虚假新闻。

Altman并不避讳如今仍未能解决的许多难点,如ChatGPT的“幻觉”问题——简言之,就是机器还是会一本正经地“胡说八道”。在这个问题上,他持续呼吁监管、公司政策和公共教育的介入,“我认为我们还需要规则、指导方针,以及大模型公司在信息披露上的预期。”他表示。

其实,OpenAI今年已经针对选举场景实行了一些措施,比如禁止“生成大量竞选材料”,但真正到了大选时效果如何,还有待确认。

事实上,Altman对议员们的许多问题都表示肯定和关切,但谈及具体落地的保护措施,却很难提供清晰的方案,这也难以让议员们信服。

当参议员Amy Klobuchar提及,生成式AI会让人们都去问ChatGPT,而不是看当地的媒体,如何保障创作者权益时——Altman承认保护当地新闻很重要,但却拒绝提供确保创作者的收入和对其付费的细节。

回应热点:AI将创造更多就业,不应暂缓大模型研究

听证会上,议员们对AI大模型所将引发的社会问题表达了深切的忧虑,最先被抛出的是就业。

“尽管媒体大肆宣传我们与AGI(通用人工智能)并没有那么接近,但我想说,我们现在所拥有的只是我们将的AI的一小部分样本。”Gary Marcus认为,人们不应该小看AI对就业带来的影响。

Sam Altman和Christina Montgomery都否认了这一论调。

“GPT-4是一个工具,而不是一个生物,认识到这点很重要。”Altman认为,GPT-4目前仍然可以很好地为人们所控制和使用,它会让一些工作自动化,甚至被替代掉。但人类利用AI大模型可以拥有更多能力、更多时间追求自己喜欢的事物,这将创造出更多工作机会。

IBM的Christina则认为,AI大模型“将会改变每一项工作”,如今的工作重点应该是做好新老工作的过渡——她更是承诺,到2030年,IBM将培训3000万个人掌握当今社会所需的技能。

任何新技术的快速普及过程中,都会存在垄断隐忧。听证会上,议员用Web3的例子类比:去中心化技术却以少量公司为掌握中心。对AI技术垄断可能带来的意识形态风险,他们表达了担忧。

对此,Altman认为技术开源并不是最佳的解法。“(开源)有好处也有危险。”即便开源能破除大公司垄断,但现阶段能提供模型能力与大公司抗衡的开源社区依然较少,同时,技术的开源会增大AI风险的扩散范围——基于这一原因,Altman认为现阶段由少数公司掌握技术能够为提高AI的可控性带来好处。

而在3月,GPT-4的强大效果已经引发学术界的担忧,以Elon Musk和Yann LeCun为首的一大批科学家、业界人士在联名信上签字,呼吁暂缓至少6个月的类GPT-5产品的研究。

而Altman和Christina都认为,单纯暂停6个月研究“可能用处不大”,更重要的点不是放在限制研究,而是应该放在落地应用、面向公众开放前的审核、评估环节。

Altman表示,OpenAI在开发完GPT4之后,等了超过半年才推进落地应用,而目前OpenAI也并没有GPT-5的研究计划,他认为目前的研究进度仍在掌握范围内。“如果我们训练过程中真的遇到了不能理解的情况,那是需要停下,但如今我们还没看到这样的趋势。”

双方达成监管共识,Altman提议给AI企业上牌照

Altman并不排斥来自政府的监管。

在听证会开始不久,他就明确表态,政府的监管对于减少模型的风险“将至关重要”。同时他也建议,监管举措不应扼杀创新,“AI公司必须满足相关安全要求,也要有足够灵活的管理制度,以适应新的技术发展”。

当议员们讨论起当年关于社交媒体的第230条法规时,Altman提出了他的想法——像ChatGPT这样的AI需要一个新的制度,“我们要想出一个责任框架,这是一个超级重要的问题。”早在听证会之前,他曾多次表示,对于AI,“我们需要一部新法律”。

作为AI赛道最有代表性企业的创始人,Altman在听证会上获得了充分的机会阐释他对监管方式的思考。就美国政府应该如何监管AI公司,他提了三条建议:

1. 组建一个新的政府机构,负责给AI厂商提供许可证,并吊销不符合政府标准的厂商的许可证。

2. 为AI大模型创建一套安全标准,包括评估其风险,大模型必须通过一些安全测试。

3. 指派第三方专家独立审核AI产品的各方面指标。

与此同时,Altman支持创立一个为AI制定相关标准的国际组织,由美国领导。他说,各国政府如何监管核武器是有先例的。参与质询的前纽约大学教授Gary Macurs也呼吁成立专门的政府机构,以解决AI可能的风险。

听证会结束后,Altman接受媒体采访 拍摄:孙佳怡

听证会结束后,Altman还没法立即回家。快速回答完场外十几家媒体的问题后,他还要赶去参加国会AI核心小组召开的闭门会议——会议的结果或许会引导AI监管的走向。

对OpenAI而言,一次听证会还远远不够。以ChatGPT为代表的AI大模型要解决的监管难题,才刚刚开始。

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK