迈入 8K 时代,AI 驱动超高清 “视” 界到来

source link: https://my.oschina.net/u/4713941/blog/5175042

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

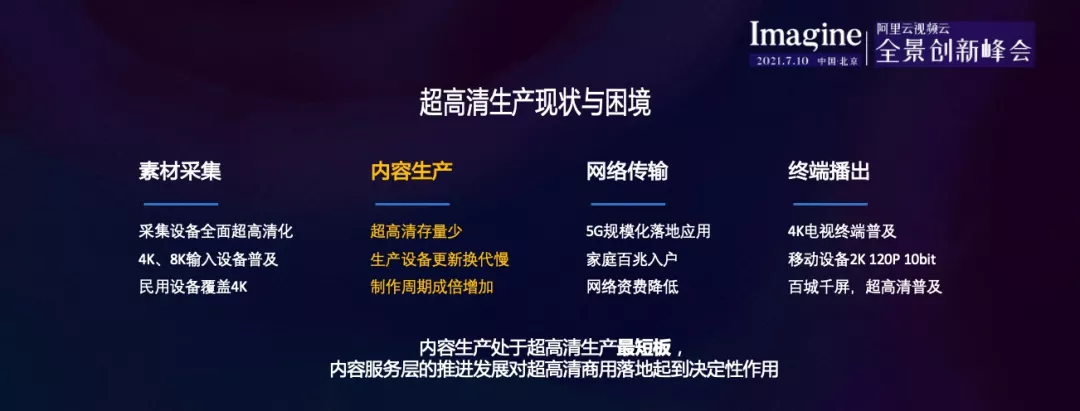

2021 年,超高清迈入 “8K” 时代。超高清视频将带来全新视听体验,但超高清生产在内容生产层面也面临着超高清存量少、生产设备更新换代慢、制作周期成倍增加的困境。在 7 月 10 日的 Imagine 阿里云视频云全景创新峰会上,达摩云资深算法专家谢宣松,发表了《AI 技术驱动超高清 “视” 界》的主题演讲,从超高清产业的生产现状与困境出发,深度剖析 AI 技术如何驱动视听升级,并分享了达摩院在超高清生产领域的实践经验,以下为演讲内容整理。

超高清产业发展现状

视觉是一个生理学词汇。通过视觉,人和动物感知外界物体的大小、明暗、颜色、动静,获得对机体生存具有重要意义的各种信息。从物理现象角度来看,也就是视网膜对光的各种感应,包括光的亮度、细节描述,还包括跟时间相关的这些信息。而对视觉冲击力最大的就是视频。

AI 在视频方面能发挥什么作用?

AI 在视频发挥的作用主要分成两部分,第一部分是最基础的,AI 对视频或者图像的理解,体现在我们视频中常见的分类、打标、检测、分割等。AI 是与人相关的,因为人肯定一上来先理解世界,所以 AI 要发挥它的作用,第一步就是理解学习。

第二部分和生产类相关,比如生产、编辑、加工、擦除、插入等,其中 AI 在底层视觉就是发挥它的增强作用。那么 AI 是如何在底层视觉上发挥它的作用的呢?

视觉是人类最重要的感觉,所以视频的体验的问题是重中之重。体验会和很多东西相关,人类也在不断追求着体验,第一是清晰度的追求,从 4K 到 8K,信息包含量越来越多,细节的丰富程度也越来越高。2021 年 4k 超高清视频已经普及,并迈入 8K 高清时代。

第二是色彩,更生动的色彩,这也是影响人体验的一个非常重要的地方。第三个则是更沉浸式的体验。

那 AI 可以发挥些什么作用呢?能不能在各行各业进行应用呢?

首先是超高清视频,2014 年国家发布 4K 的战略,到现在已经过去了 7 年,4K 开始朝着更高的 8K 方向发展。在这个过程当中内容永远是滞后的,基础设施反而是超前的,像 4K 电视,现在消费者仍然不会去购买一台最基本配置的 4K 电视,而信号的基础设施已经迈向了 8K、5G。

去年春节进行了第一次 8K 直播,东京奥运会、北京冬奥会都会有 8K 直播,而且 8K 的直播会越来越多。

但 8K 直播有很多困难,因为视频是完整内容生产的过程。其实有很多环节,例如素材采集,素材采集现在已经消费级别化了,1080P、4K 级别的素材采集,利用手机就可以满足。但怎么生产内容,拍一下视频是否就算是生产了?

其实它只是最基本最简单的生产,对内容生产来说分两块:第一块是存量的内容,从古老的黑白到后来有色画面但分辨率很低的内容。技术和人的体验的要求越来越高,所以之后的内容制作的周期和要求越来越高。

技术在内容生产方面可以发挥巨大的价值,因为技术无外乎两个东西,第一个降本提效,这是最根本的。第二是创新,能够快速快捷低成本创造新的机会。

所以技术在这块会发挥非常大作用,包括网络传输、终端是需要完善整个产业链的。而我今天所讲的只是其中的一个点,但这一点也需要非常多技术来补完。

AI 技术驱动视听升级

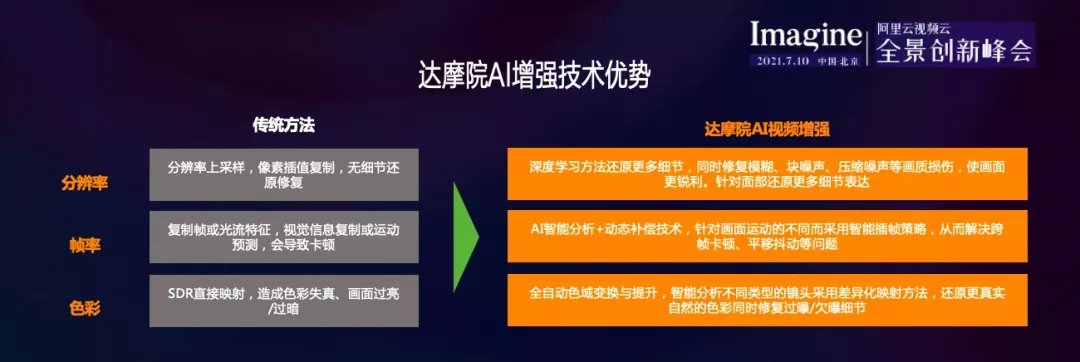

要提高视觉体验,最基本的是增加可以观察到的细节,而跟细节最相关的就是分辨率,但分辨率需要终端设备支持,所以这是第一点,也是最重要的。

第二是流畅丝滑的视觉体验,目前大部分是显示器是 60 赫兹,但也有 120 赫兹、240 赫兹、甚至 360 赫兹的显示器,赫兹代表着屏幕每秒的刷新率,也就是每秒钟屏幕出现图像画面的次数。屏幕支持的赫兹数越高,每秒显示的画面也就越多,视频观感也更流畅。

之前的带宽不足,不足以支持那么多的画面信号传输,而视频本身的帧数也达不到流畅的体验。

当然,技术可以弥补视频自身上的不足,来提高视频的视觉体验。

第一个是关注细节,第二关注流畅度,第三关注色彩。4K 内容是有国家明确规范的,你要想称之为 4K 内容,你要先满足这些条件。

从这三个层次来看,技术上追求细节可能就会出现很多瑕疵,因为这里很多初试者,经常用 GAN 系列技术,在生产过程当中会经常出现不可控因素,导致出现瑕疵。

实话说,我一直想把视觉生产定义成可控的视觉内容生产,既能够保证细节的还原,同时又能够保证瑕疵的控制,这需要很核心的技术,这是第一。

第二个,算法除了要控制超分辨率以外,另外算法的源头是什么?是数据,大家普遍觉得数据有两种,低分辨率和高分辨率,因为低画质和高画质是一对的。

这些数据怎么获取,有很多手段。主要的办法是用人工的方式、高成本的方式,获取这两种数据,能不能用技术的方式真正生产高仿真、高真实的数据对(data pair),这是未来很大的一个课题。

最后要使 AI 技术在实践当中使用,把效果和效率上平衡做好,这本身也是个问题。

第一个要解决的是数据规模。因为 AI 的数据规模是海量的,在这些场景大家感受到的比较差的画质,很多细节都已经损失掉了。很多模糊的东西,色彩不对的地方,AI 是无法凭空绘制出这些数据的,所以能不能设计个方案,使 AI 用算法自动获取真实的数据,目前,这是非常难的一个课题。

在比较早的时候大家用简单的方式,要想追求更好一点,可能用一些数据核,使得清晰的画面变得不清晰,然后去制造一个数据对。当然可能做了核之后加一些东西,加一些噪声,那有了这些以后是不是就行了?其实也不行,因为所有的视频要通过编码、解码,在传输过程中又会产生很多损失。

所以怎么模拟损失的那部分?设计一个好的算法,对编解码本身也是很好的,这一系列考虑下来,低质和高质的数据对可以做非常多事情,这里面牵扯到对噪声的分析、场景的分析,不同场景关注点的不一样,动漫画更关注边缘,运动场景比较高的关注运动的动作,还有复杂的场景可能会关注很多的细节。

所以在这些方面需要做非常多的数据分析和数据生产,也许平时大家就是做一个算法,让一堆人打标,画框就行了,所以在这个问题中,数据对的生成是个命题,怎么获取到真实的训练数据。当然这个数据除了真实以外还要有规模,达摩院在技术这一方面花费了很多的努力。

超高清生产实践

接下来怎么增强?比如怎么增强人像,我们现在比较重要的方法就是加入 GAN 系列技术进去,达摩院开源了 GPEN 的高清算法。

在中国共产党建党 100 周年的各种视频新闻中,很多人像基于这个算法做了修复,在 B 站等各平台播放,起到了很好的 PR 作用,这些都是基于达摩院的算法去修复的。

这里面第一个加入了 GAN 的先验网络也加了生成式数据发生器。基本分三大类,第一类针对内容的,当然针对特征层面的,还有针对 GAN 层面的 Loss 在里面,所以可以得到针对人像非常好的基础模型。这是其中一种。

当然对真实的物理世界来说人虽然是最重要的,但文字、风景等各种细节,也需要算法来完善增强。

关于解决流畅度的问题,在很多时候,尤其在运动变化率非常大时经常会出现瑕疵,所以怎么在不同的尺度、出现不同的瑕疵时,检测并弥补修复,然后提升流畅度,这需要很多的工作来完善。

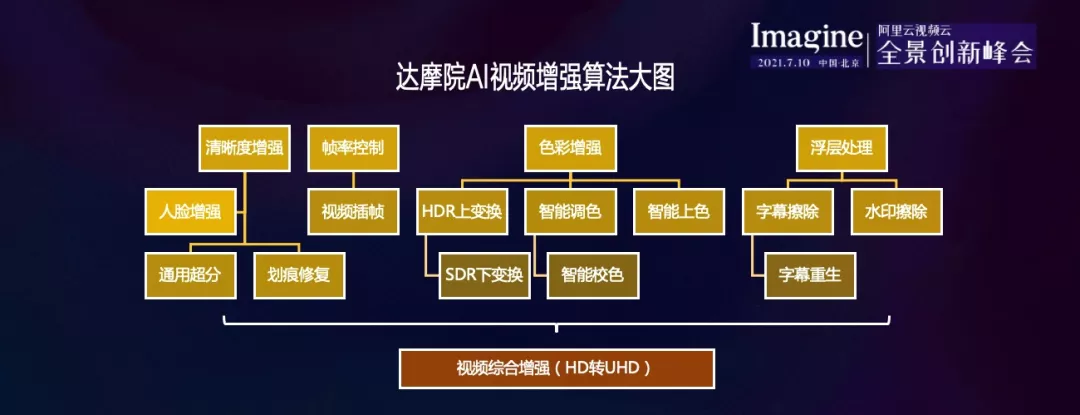

除了细节增强,数据的还原、生成,还有瑕疵的检测,差分的检测,颜色的调准,非常多算法可以发挥它的作用,这一系列组合起来视频才能够完成从低清到 4K 到 8K 的演进,这本身也是个系统工程。

所以从这三个维度也无所谓传统与不传统的方法,大家都是利用深度学习的方法增强分辨率,帧率、色彩还有细节,还有在不同场景下怎么完善算法更好。

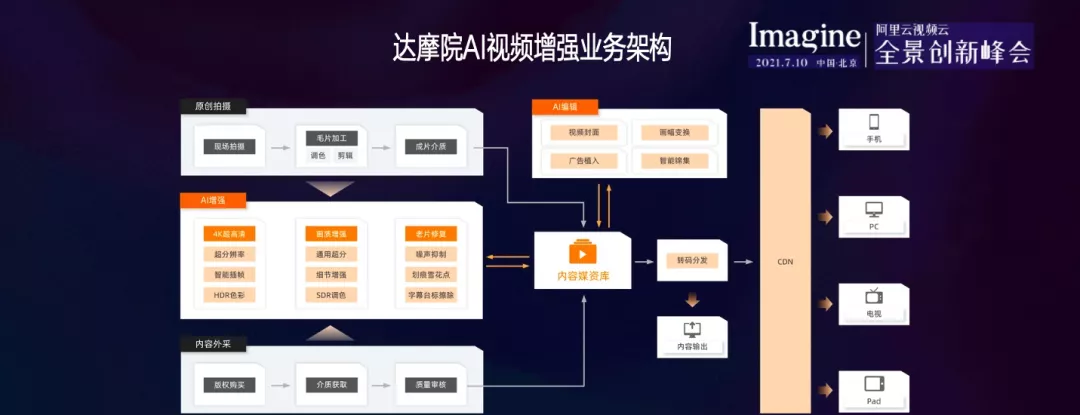

有了这些算法,形成真正可用的产品和服务还有很长的路要走,这就是系统工程要做的事情。基本来说,从原创的素材,加上 AI 视觉生产、智能生产,画面增强,还有内容加工,得到内容之后怎么编辑、修改、生成封面、拆条,这里面都可以做很多的技术来发挥作用。

上图展现了人物照片 AI 增强后的效果,利用开源的 GPEN 高清算法实现面部增强,增强后的视觉效果很棒,但实际上还有很多难点在里面,如果这个照片源头非常差或者受到很严重的污损,要想做好的增强还是很困难的。

另外这是一个综合的东西,可能用到面部的增强,但也不能脱离环境生产,要和背景相结合。如果是很古老的照片,还要做色彩还原,包括黑白变成彩色等。

画质增强,当然对于视频来说更复杂,原始画面的比较暗,但加上色彩会更加生动,再加上超分以后细节更突出,这时车不是那么流畅,加一个差分使得汽车行驶画面更流畅。从色彩到细节再到流畅度再加上场景增强,形成了完整的视觉增强,这是属于视频视觉处理技术。

达摩院视频综合增强 效果展示

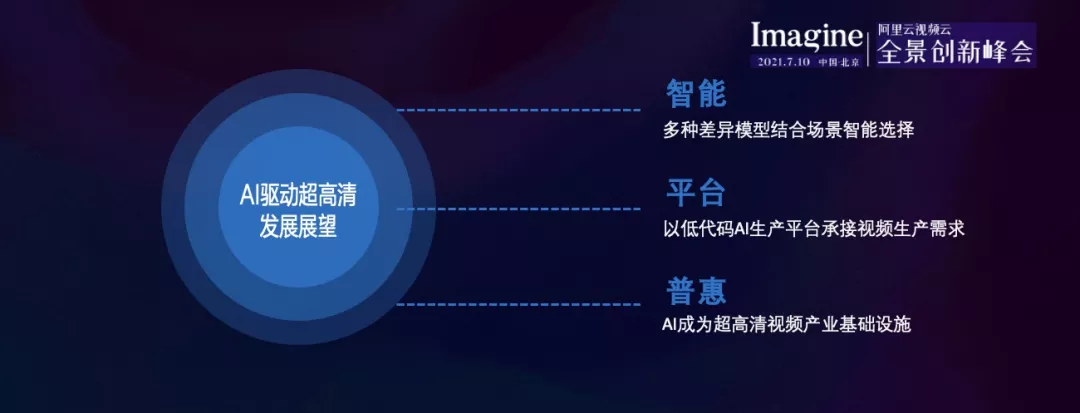

最后 AI 驱动高清往前走,智能是最基本的,达摩院是做 AI 技术的,所以能不能自适应去做事情非常重要。自适应好像很简单,但事实上在不同的场景,AI 技术并没有所谓的普适性的能力。

在有卡通时,有新闻人物时,有纪录片时,我们希望 AI 能够有适应的完整系统,用万能的模型去处理,而不是单一的模型,使 AI 自适应的针对不同场景采用最优质的算法。

最后自我评估这是很重要的有意思的话题,对于主观的视频增强技术好不好,如何去评判它,本身也是很困难的事情,达摩院也会在视频增强技术投入很多的时间去做,去完善。

当然还需要系统去承载它,视频云就是这个基础设施平台,使得可以高效率规模化地做各种各样 AI 视频视觉增强的任务。

当然现在 AI 慢慢朝着两个维度走,第一个走向消费者,平民百姓,为大家服务。另外深入到各行各业为大家提供降本提效,以及创新各种各样的机会。AI 技术将基于视频云,驱动未来的高清视界。

「视频云技术」你最值得关注的音视频技术公众号,每周推送来自阿里云一线的实践技术文章,在这里与音视频领域一流工程师交流切磋。公众号后台回复【技术】可加入阿里云视频云产品技术交流群,和业内大咖一起探讨音视频技术,获取更多行业最新信息。

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK