全世界都被骗到了?英伟达发布会「数字替身」出场 14 秒,暴露了一个大问题

source link: https://www.ifanr.com/1434274

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

黄仁勋骗过了全世界,三个多月都没人发觉!皮衣是假的厨房是假的,连他自己都是假的!

这两天,一则震惊科技圈的消息四处疯狂刷屏。事情是,英伟达最近公开了 4 月 GTC 发布会的幕后纪录片,展示技术人员如何通过 Omniverse 平台,制作现场各种 3D 仿真特效。其中包括完美复制出黄仁勋家的厨房,以及,合成了他本人的「数字人」。

什么?眼前如此逼真的黄老板竟然不是活人?

先不要激动,不是你想的那样。实际上据英伟达博客称,当天 1 小时 48 分的发布会里,「数字人」出场只占了 14 秒(原片 01:02:41 – 01:02:55)。这 14 秒之外,全都是黄仁勋本人在演讲。

21 个真假黄仁勋

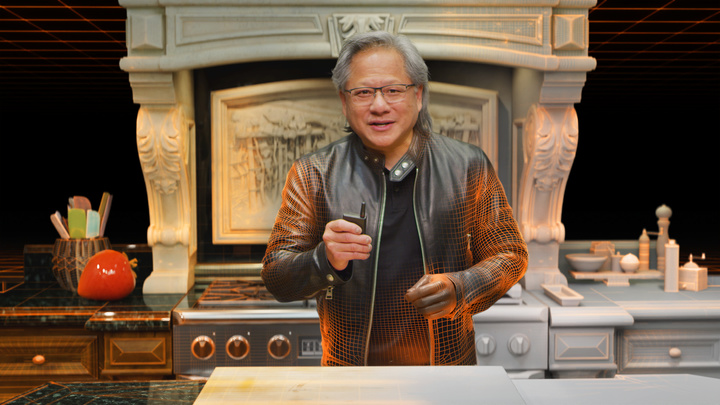

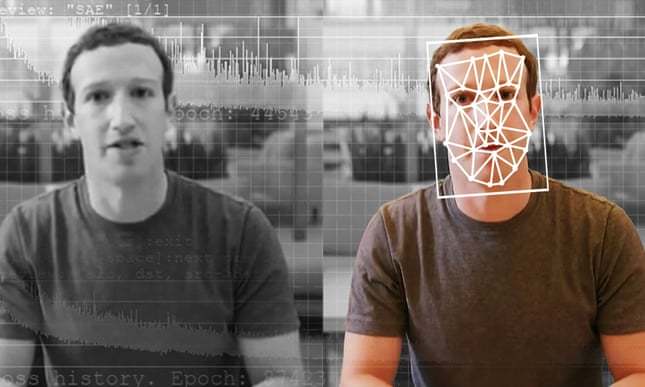

被英伟达称为发布会高潮时刻的 14 秒,是长这样的:

在介绍英伟达首款 CPU Grace 时,真厨房瞬间变成假厨房,并像变形金刚一样开始「解体」。然后,场景进入虚拟空间,黄仁勋的「数字人」便穿着他的假皮衣上场了。

▲ 你没看错,由于疫情,这两年英伟达发布会都是在 CEO 家厨房开的

你完全可以把这段理解为对 Omniverse 平台的炫技晒肌肉。官方描述称,这 14 秒将英伟达的深度学习与图像研究团队、工程师团队和设计师团队的工作,都很好地结合到了一起。

为了复刻这个厨房,技术人员从不同角度拍了几百张照片,再进行 3D 建模。据称,这里边东西多达 6000-8000 件。他们还在假厨房里悄悄埋了 3 个彩蛋:一台印有英伟达 logo 的咖啡研磨机、一罐品牌名叫 Tao 的橄榄油,以及一个黄仁勋模样的乐高小人。

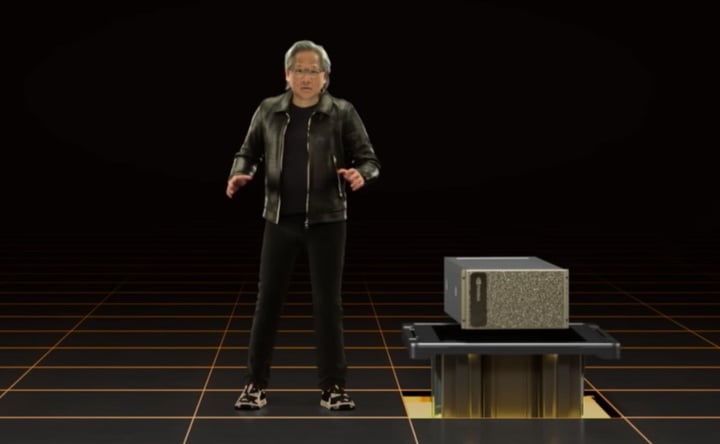

至于「造假」CEO 本人,需要先给黄仁勋(和他的皮衣)来一次全身的 3D 扫描,以几千张照片为基础来建模,再用 AI 训练面部动作和表情。

另外,他们找来了专门的演员,特意对黄仁勋过往演讲的肢体语言进行学习模仿,再进行长达 8 小时的动作捕捉。在多番细节调整后,团队做出了 21 个版本的「数字人」,供老板最终挑选出镜。

真的假的?14 秒背后的大问题

在 YouTube 上,这条幕后纪录片的简介是:看一群艺术家,如何在英伟达发布会 Keynote 中模糊现实和渲染的界限。在博客正文,英伟达表示,厨房「解体」的瞬间让观众们大吃一惊,大家开始怀疑整个发布会到底有多少是真实的,有多少是 AI 的功劳。

老实说,回头认真看这 14 秒,厨房「解体」的效果还算惊艳,但合成版黄仁勋的肢体动作比较僵硬,甚至口型有些对不上。要辨别出来是 AI 的杰作,跟真人版区分开来并不算太难。

但最初在误读的消息传出时,我也一度陷入自我怀疑,开始感觉这 1 小时 48 分钟里,黄老板真人出镜时的每个笑容,似乎都有着扎克伯格同款的机器人味道。

嗯,看来他是假的。嗯?他真是假的吗?

为什么我们会为真假老黄的问题而感到困惑?可能是因为,我们生活在一个「眼见未必为实」的世界里。

以 Deepfake 技术为例,曾经它被用来生产女明星换脸色情影片,或政客名人假新闻。如今,这项技术的应用变得更广泛了,只需要一张大头照,你身边的女同事或女性朋友都可能成为裸照受害者。

万物皆可 Deepfake 的年代,任意篡改视频和语音也只是基操勿 6。

电话那头的人类萌妹,实际上可能是抠脚大汉诈骗犯在操纵的 AI。2019 年,就有骗子通过 AI 合成的语音,冒充一家英国能源公司德国母公司的 CEO,成功从该公司员工手里骗走 22 万欧元(约合 173 万人民币)。

今天,就连直播都未必可信。举个例子,英伟达最近推出了一种实时虚拟形象技术。即使程序员正戴着口罩在咖啡馆摸鱼,对方在实时会议画面里看到的,也可以是他此刻人在办公室西装革履风度翩翩。只要你愿意,还可以瞬间切换到阳光与海滩的度假形象。

多位专家提醒,这种现象很容易让人们对社交网络的内容、乃至对整个社会的不信任。

随着现实和虚拟的界限日渐模糊,我们分辨人类和 AI 的雷达将会频繁失灵。在元宇宙(Metaverse)或将成真抵达的未来,你问我眼前的老黄是不是真老黄?我真不敢回答。

人类需要一个小小的陀螺

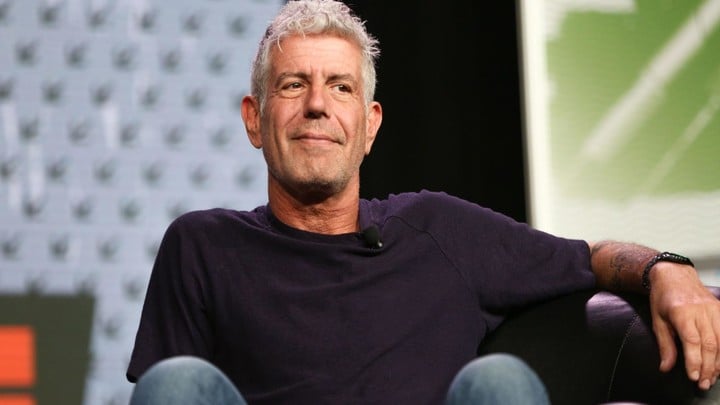

就在上个月,CNN 纪录片《Roadrunner: A Film About Anthony Bourdain》引起了一波关于 AI 使用道德伦理的讨论。

纪录片的主人公,是已故的明星厨师 Anthony Bourdain。片中采用了很多他生前的视频和音频素材,但有一点,导演并没有主动告知公众:有 3 句听起来像是 Bourdain 本人叙述的旁白,其实是由 AI 技术模仿生成的。

▲ Anthony Bourdain

虽然这 3 句话的原文都来自 Bourdain 撰写的邮件,但仍然让人感到不适、愤怒和被欺骗。纽约大学新闻学教授 Meredith Broussard 表示,跟虚构的影视作品不同,人们认为纪录片是真实的,如果作品中使用了 AI,就应该明确说明。

Gartner Research 的分析师 Nicole Greene,也赞成在 AI 介入的时候明确告知,「不管是品牌跟虚拟偶像合作,还是电影用 AI 技术重现逝世演员的角色,只要消费者知道正在发生的事情,他们是可以接受的。」

▲《速度与激情 7》,用 CG 特效让 Paul Walker「起死回生」

从 2015 年开始,美联社一直使用 AI 自动生成公司财报类新闻,每一篇都会附上注释:「本故事由 Automated Insights 自动生成」。清清楚楚告诉你,这就是 AI 搬砖写的稿子。

这简单的一句说明,就像是恐怖电影开始前的「家长指引」,方便面包装和汉堡广告的「一切以实物为准」。它是最基本的信息告知,也是生产方对消费者的负责任。在 Deepfake 等技术作恶消耗信任的时代,甚至能带来信任的重建。

我们并不拒绝 AI 闯入现实生活,毕竟,它为高效和创意带来了无限种新的可能性(至于 AI 的滥用,那是另一个话题了)。但我们都希望能拥有知情权。

目前全球最火的虚拟偶像之一 Lil Miquela,2016 年出道,2018 年才承认自己并非真实的人类。现在,她的 Instagram 自我介绍写的是「一个住在洛杉矶的 19 岁机器人」;而同样受欢迎的 Imma,则称自己为「对日本文化感兴趣的虚拟女孩」。

虽然本质上只是一串由 0 和 1 组成的代码,但丝毫不影响年轻人对她们的追捧。今天,Miquela 和 Imma 坐拥百万粉丝,时尚和广告合作资源接到手软,是名副其实的社交网络红人。

▲你能看中图中哪位模特是真人吗?

回头看这次英伟达的真假黄仁勋,如果能劳烦 AI 或工作人员在演示画面加一行说明,是不是就可以避免「震惊!全世界都被骗到了」「发布会中的老黄全是假的」这种乌龙事件?

在真假难辨的世界里,人类需要有《盗梦空间》里那个旋转或倒下的陀螺,提醒我们:前方是虚拟空间,请保持警惕,小心通行。

目前,Facebook、Google 和 Twitter 等互联网公司都在研究如何检测并遏制 Deepfake 视频的传播,一些地区也颁布了相关禁令。但这仍然像是一场「猫抓老鼠」的游戏。

至于 AI 的使用界限和道德伦理问题,未来估计也会有相关法律法规出台。朋友,我们正站在元宇宙的入口,假亦真时真亦假,一切才刚刚开始。

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK