通义千问跳科目三,关AI电商啥事?

source link: https://www.yunyingpai.com/media/982587.html

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

通义千问跳科目三,关AI电商啥事?

2023年,AI大模型几乎颠覆了我们的生活,科目三不动也能跳,一张照片即能生成视频,它又是如何与电商结合的呢?就让我们一起来看看吧!

海底捞的小哥们,为了科目三,崴了多少脚。

但是千算万算,没有算到在通义千问悄悄上线的“全民舞王”的助攻下,只需要一张照片,人人都可以科目三。

以现在大模型的“姿势水平”,文字生成文字,文字生成图片对它而言已经变成了“小儿科”,不管大家在排行榜上竞争得如何激烈,真正的竞争,其实已经到了跨模态生成领域——“全民舞王”的图片生成视频是这样,让马斯克和扎克伯格等知名外国人在视频里说中文也是这样。

而且,“全民舞王”依托的Animate Anyone大模型,已经不止停留在“玩具”层面上。结合阿里云最新的Outfit Anyone“一键试衣”大模型,未来我们在淘宝买衣服,上传一张照片就能看到动态的上身效果视频,已经不再遥远。

阿里心心念念的“AI电商”,如今又多了一张拼图。

一、国外已经火了三个月

科目三之所以成为“现象级”舞蹈,并不是因为它在国内短视频平台有多么“火”,因为五六年前的社会摇已经做到了这一点——而是它能不能成为文化输出的一个符号,进而获得登堂入室的门票。

单论结果,科目三现在早就走出了短视频平台,还被做进了游戏,走上了国际化大舞台。

譬如在去年12月9日的世界体育舞蹈大赛上,世界冠军克里斯蒂娜和几位舞者一起展示了国标版“科目三”;腾讯上线刚一个月的“正版合家欢派对游戏”《元梦之星》里面,老壶也发现了角色专属的“科目三”表情动作。

再到如今的“全能舞王”,只需在通义千问app里面上传一张全身照片,再等待10分钟左右,就能生成一段10秒左右的跳舞短视频。

进入“全民舞王”的模板区,有DJ慢摇、只想对你说“爱你”、鬼步舞、蒙古舞、科目三、划桨步等12种热门舞蹈的模块可以选。虽然可以选的有很多,但就流量和关注度而言,科目三自然是毫无疑问的C位。

捋一捋时间线也能发现,国外短视频达人开始“病毒式传播”科目三的时间点,恰好是在去年10-11月份左右。差不多在同一时期,阿里云旗下团队就发布了“全能舞王”相关的大模型技术文档。

要知道,科目三这个舞种不同于一般手势舞,是需要一定的舞蹈基础和四肢协调性的。换句话说,在国外也并非所有人都能轻松驾驭。

但阿里云发布的这篇论文,则通过“Animate Anyone”的模型,将固定的角色图像转化为特定姿势序列控制的动画视频,换句话说,之前一点舞蹈基础都没有的人,现在可以通过这个模型,开局只需一张图,就能为所有舞蹈小白,提供了在短视频领域“走上舞台”的可能。

也因此,这条介绍“Animate Anyone”的推文在发布不到一个月,就斩获了超过5000万的点击,也就不足为奇了。

二、让图片跳起“科目三”

在“Animate Anyone”出现之前,从静态图像到动态视频的合成,仍然有很多“坎”需要过,

首先是细节一致性。举个例子就是,现在市面上的AI图片或者文字生成视频,很多时候主体之外的图像会出现局部变形、细节模糊和帧数不可控的问题,这些都会影响视频生成的质量。

再比如动作控制和连贯性。因为视频如果要商用,视频里人物的动作是需要保证可控性的。如果是AI生成,则主要通过预先输入的动作序列来控制角色动作。但在目前AI视频的角色动作,还无法完全靠prompt精准控制。

在图片生成文字的过程中,还需处理的是图像到视频的转换过程,并且需要保证这个过程中,图像的空间与时间一致性。

在此之前,诸如stable Diffusion、midjourney等AIGC产品虽然已经初步具备了文生图和图生图、图生视频等跨模态生成能力,但在AI生成视频领域,前面提到的问题仍然没有得到解决。

“Animate Anyone”则在很大程度上,对前述相关问题作出了改进。首先团队通过名为“ReferenceNet”的辅助模型,用来捕捉参考图像的空间细节,这保证了角色每一帧外观细节的一致性;

其次,团队使用了一种高效的Pose Guider姿态引导器,这让角色的运动姿势得到了有效控制,体现在视频中,则是让视频角色按设定好的姿势进行运动,并具备稳定的过渡,保证连续性和流畅性;

此前AI生成的视频细节为何不可控,很大程度上是因为每一帧的时间关系不够紧密,很多细节没办法保留到下一帧。在“Animate Anyone”的模型里,则通过一个时序生成模块来保证多个视频帧之间的关系,很多高分辨率的细节得以全程保留。

即便是解决了这么多技术难题,单看目前“全能舞王”的生成效果,也与真人上镜有一定的差距。譬如生成的舞蹈节奏是平均的,但现实音乐大多数都是快慢分布。这让“科目三”的生成效果不可避免打了折扣。

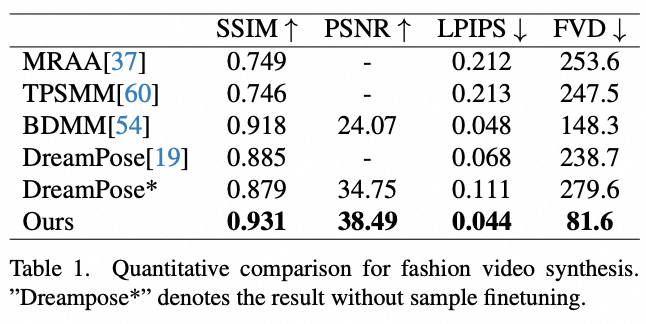

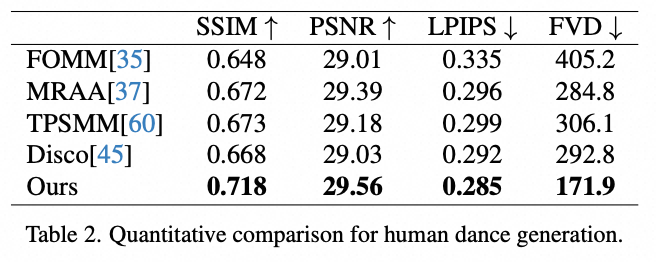

但与一众大模型前辈相比,“Animate Anyone”已经把最重要的形象一致性和姿态稳定、多帧关系控制等关键问题搞定,在图生视频赛道上,已经完成10-60+分的突破。

三、AI电商的另一块拼图?

图生视频从10分到60分,意味着什么?

意味着它不仅可以完整保留人脸、身材比例、服装细节和背景信息,同时还能对生成的动作做精准控制,且在技术上生成的视频长度不受限制。与Gen2、Pika等文本生成视频的产品比, AnimateAnyone更聚焦人本身。

也就是说,起码在图生视频这一块,“Animate Anyone”已经将AI视频从“玩具”变成了“可初步商用”。再加上阿里近期发布的“Outfit Anyone”,用户可以仅仅用服饰的平铺图,就可以实现上下装的试穿。

如果与二者结合。用户不仅可以通过上传一张照片,试穿自己心仪的大多数服装,而且可以通过动态动画,直接预览它的上身效果。与其说淘宝模特因为AI失业,不如说AI让所有人都可以成为自己的模特。

当然,“Animate Anyone”能够应用的地方也不止于此,很多游戏开发人员大可使用这种算法,将静态的游戏角色图像转换为具有不同动作和姿势的动画角色,以此实现同一款素材的多次复用,并增加对应角色的沉浸感和可信度。

而大家在淘宝买东西,最怕的是什么?就是“卖家秀”和“买家秀”的差异所带来的低可信度。但在自己的AI化身成为淘宝模特之后,这个顾虑很大程度上会被打消,交易中最重要的信任成本也因此消失。

还记得在拼多多市值刚刚超越阿里巴巴的时候,马云老师除了表示对拼多多的祝贺,还专门提到了“AI电商”的概念:“AI电商时代刚刚开始,对谁都是机会,也是挑战。”

在价格和交易环节,它可能是基于AI驱动的实时比价,助力消费者买到自己最心仪的产品;在服务和体验环节,它有可能是更优质的数字人售后和更身临其境的购物体验。

能替用户试穿衣服的“AI模特”不过只是服装品类体验的一小步,但就整个阿里AI电商的战略而言,它可能是无数基础拼图的其中一块,但也是极为重要的一块。

作者:老壶,监制:大曼,排版:玉琪

来源公众号:智商税研究中心(ID:gh_c55b3561ece1),尘世套路深,我替你踩坑!

本文由 @智商税研究中心 授权发布于运营派,未经许可,禁止转载。

题图来自 Unsplash,基于 CC0 协议

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK