论文解读(LightGCL)《LightGCL: Simple Yet Effective Graph Contrastive Learning...

source link: https://www.cnblogs.com/BlairGrowing/p/17614670.html

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

论文解读(LightGCL)《LightGCL: Simple Yet Effective Graph Contrastive Learning for Recommendation》

Note:[ wechat:Y466551 | 可加勿骚扰,付费咨询 ]

论文标题:LightGCL: Simple Yet Effective Graph Contrastive Learning for Recommendation

论文作者:Cai, Xuheng and Huang, Chao and Xia, Lianghao and Ren, Xubin

论文来源:2023 ICLR

论文地址:download

论文代码:download

视屏讲解:click

出发点:现有图对比推荐方法主要么对用户-项目交互图执行随机增强(例如,节点/边缘扰动),要么依赖于基于启发式的增强技术(例如,用户聚类)来生成对比视图。本文认为这些方法不能很好的保存图内部的语义结构,而且容易收到噪声的干扰;

贡献:

-

- 在本文中,我们通过设计一个轻量级和鲁棒的图对比学习框架来增强推荐系统,以解决与该任务相关的关键挑战;

- 我们提出了一种有效的对比学习范式用于图的增强。通过全球协作关系的注入,我们的模型可以缓解不准确的对比信号所带来的问题;

- 与现有的基于gcl的方法相比,我们的方法提高了训练效率;

- 在几个真实数据集上进行的大量实验证明了我们的LightGCL的性能优势。深入的分析证明了LightGCL的合理性和稳健性;

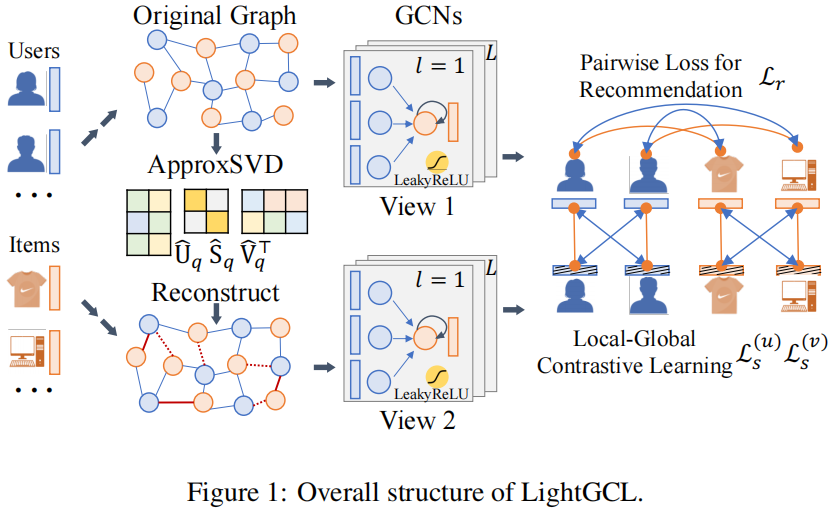

2.1 模型框架

2.2 局部图依赖关系建模

使用一个 两层的 GCN 捕获用户-物品之间的局部关系:

z(u)i,l=σ(p(˜Ai,:)⋅E(v)l−1),z(v)j,l=σ(p(˜A:,j)⋅E(u)l−1)

最终的用户和物品嵌入表示如下(每层嵌入的加和):

e(u)i=∑Ll=0z(u)i,l,e(v)j=∑Ll=0z(v)j,l,ˆyi,j=e(u)⊤ie(v)j

2.3 高效的全局协作关系学习

为使图对比学习与全局结构学习一起进行推荐,引入 SVD 以便从全局的角度有效地提取重要的协作信号。

首先对归一化邻接矩阵进行 SVD 分解:

˜A=USV⊤

注意:U 和 V 分别是 I×I 和 J×J 的矩阵,S 是 I×J 的对角矩阵(主对角线为从大到小的奇异值);

由于最大的奇异值通常与矩阵的主成分相关联。因此,本文截断奇异值列表以保持大的奇异值值,并重构被截断的归一化邻接矩阵:

ˆA=UqSqV⊤q

注意:Uq∈RI×q、Vq∈RJ×q、Sq∈Rq×q;

①:通过识别对用户偏好表示很重要和可靠的 user-item 交互来强调图的主成分;

②:生成的新图结构通过考虑每个 user-item 对来保持全局协作信号;

g(u)i,l=σ(ˆAi,:⋅E(v)l−1),g(v)j,l=σ(ˆA:,j⋅E(u)l−1)

ˆUq,ˆSq,ˆV⊤q=ApproxSVD(˜A,q),ˆASVD=ˆUqˆSqˆV⊤q

G(u)l=σ(ˆASVDE(v)l−1)=σ(ˆUqˆSqˆV⊤qE(v)l−1);G(v)l=σ(ˆA⊤SVDE(u)l−1)=σ(ˆVqˆSqˆU⊤qE(u)l−1)

2.4 简化的局部-全局对比学习

传统方法:采用三视图范式,使用增强图之间的对比策略,而不使用原始图;

本文:认为,增强图之间的对比可能带来错误信息知道,可能是由于破坏了图结构,然而,在本文提出的方法中,增强图视图是通过全局协作关系创建的,这可以增强主视图的表示。

L(u)s=∑Ii=0∑Ll=0−logexp(s(z(u)i,l,g(u)i,l/τ))∑Ii′=0exp(s(z(u)i,l,g(u)i′,l)/τ)

推荐任务损失:

Lr=∑Ii=0∑Ss=1max(0,1−ˆyi,ps+ˆyi,ns)

L=Lr+λ1⋅(L(u)s+L(v)s)+λ2⋅‖Θ‖22

__EOF__

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK