图像生成终结扩散模型,OpenAI「一致性模型」加冕!GAN的速度一步生图,高达18FPS

source link: https://www.51cto.com/article/751992.html

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

图像生成终结扩散模型,OpenAI「一致性模型」加冕!GAN的速度一步生图,高达18FPS

ChatGPT、Midjourney的火爆,让其背后技术扩散模型成为「生成式AI」革命的基础。

甚至,还受到业内研究者极力追捧,其风头远远盖过曾经逆袭天下的GAN。

就在扩散模型最能打的时候,竟有网友突然高调宣布:

Diffusion models时代终结!Consistency models加冕为王!

这究竟是怎么回事???

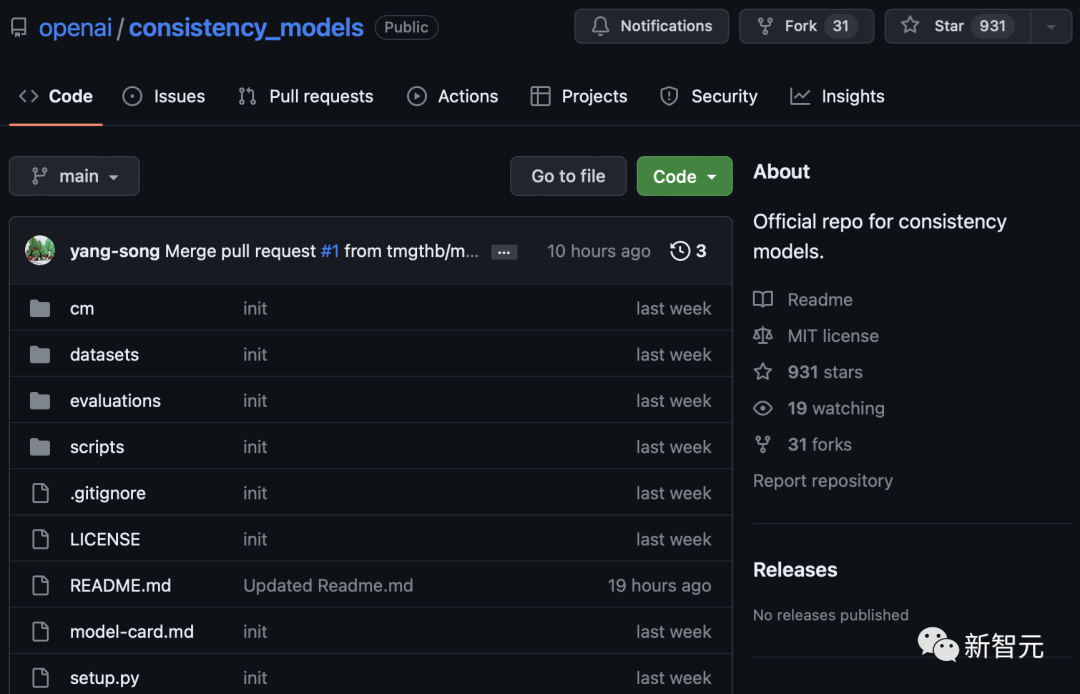

原来,OpenAI曾在3月发布了一篇重磅、且含金量十足的论文「Consistency Models」,并在今天在GitHub上公开了模型权重。

论文地址:https://arxiv.org/abs/2303.01469

项目地址:https://github.com/openai/consistency_models

「一致性模型」在训练速度上颠覆了扩散模型,能够『一步生成』,比扩散模型更快一个数量级完成简单任务,而且用到的计算量还要少10-2000倍。

那么,这到底有多快呢?

有网友表示,相当于在大约3.5秒内生成64张分辨率为256x256的图像,也就是每秒18张!

而且,最新模型最主要优势之一,就是不需要「对抗训练」就能实现高质量样本。

这篇研究由图灵三巨头之一Hinton学生,AlexNet的主要推动者Ilya Sutskever亲笔撰写,还有研发DALL-E 2的华人学者Mark Chen、Prafulla Dhariwal,研究内容有多硬核可想而知。

甚至还有网友称,「一致性模型」才是未来的研究方向,相信我们未来一定会嘲笑扩散模型。

所以,扩散模型也要不存在了?

更快,更强,无需对抗

目前,这篇论文还是未定稿版本,研究还在继续中。

2021年,OpenAI首席执行官Sam Altman曾撰写了一篇博客,讨论摩尔定律应该如何应用于所有领域。

Altman前段时间又在推特上公开谈到了人工智能正在实现「蛙跳」。他表示,「新版摩尔定律可能很快就会出现,宇宙中的智能数量每18个月翻一番。」

对于其他人来说,Altman的乐观可能看起来毫无根据。

但OpenAI的首席科学家Ilya Sutskever带领团队做出的最新研究,恰恰为Altman的主张提供了强有力的支撑。

都说2022年是AIGC元年,是因为许多模型的泉涌背后都是基于扩散模型。

扩散模型的大红大紫逐渐取代了GAN,并成为当前业界最有效的图像生成模型,就比如DALL.E 2、谷歌Imagen都是扩散模型。

然而,最新提出的「一致性模型」已被证明可以在更短的时间内,输出与扩散模型相同质量的内容。

这是因为,这种「一致性模型」采用了类似GAN的单步生成的过程。

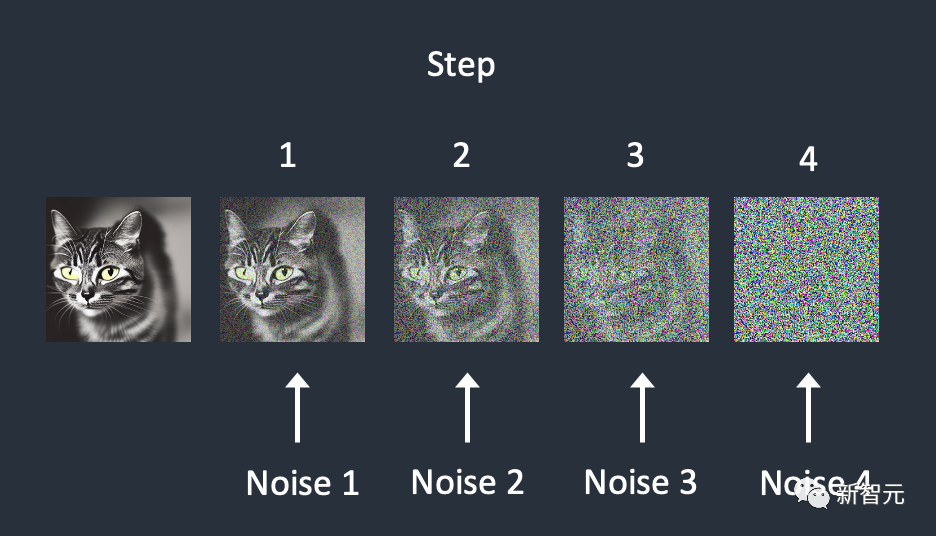

相比之下,扩散模型采用了一种反复采样的过程,逐步消除图像中的噪声。

这种方法虽然让人印象深刻,但需要依赖执行一百到数千步的步骤才能取得良好的结果,不仅操作成本高,而且速度慢。

扩散模型的持续迭代生成过程,比「一致性模型」消耗的计算量要多10-2000倍,甚至减慢了训练过程中的推理速度。

「一致性模型」强大之处在于,必要时能够在样本质量和计算资源两者间进行权衡。

此外,这个模型还能够执行零样本的数据编辑任务,比如图像修补,着色或笔触引导的图像编辑。

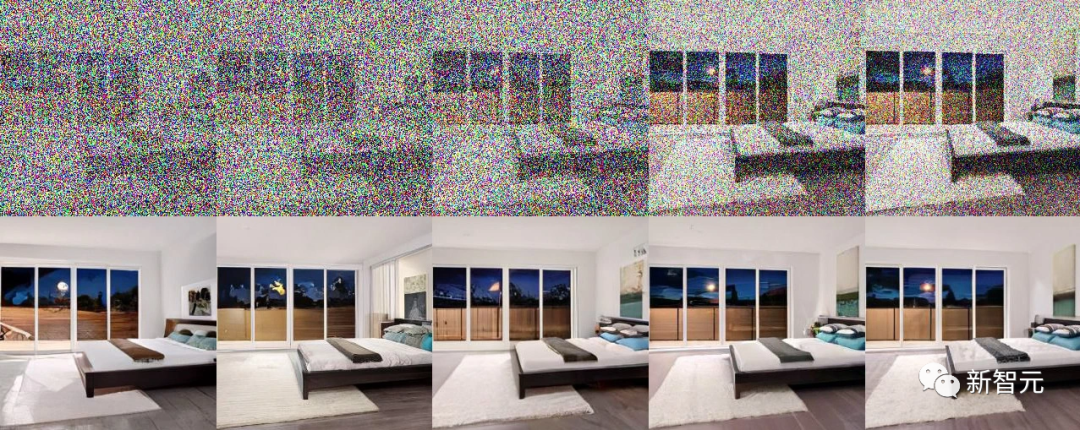

使用在LSUN Bedroom 256^256上通过蒸馏训练的一致性模型进行零样本图像编辑

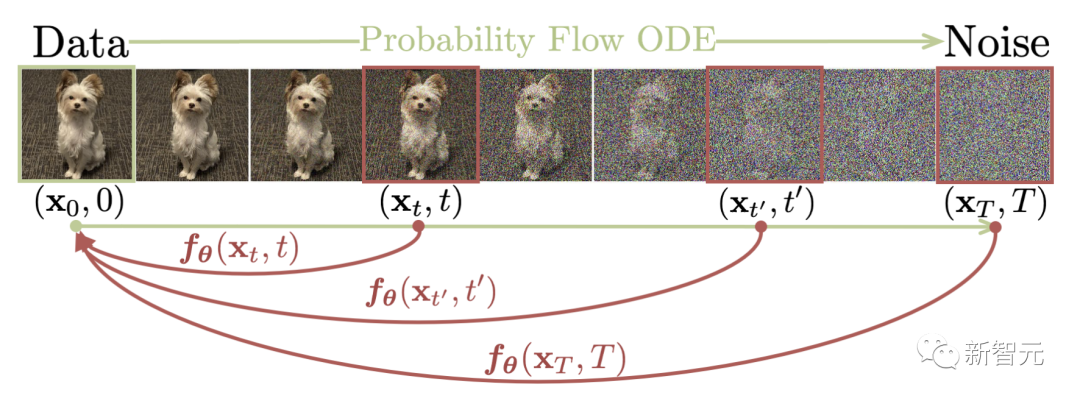

「一致性模型」还能在使用数学方程时将数据转换成噪声,并确保结果输出对于相似数据点是一致的,从而实现它们之间的平滑过渡。

这类方程称为「概率流常微分方程」(Probability Flow ODE)。

这项研究将这类模型命名为「一致性」,因为它们在输入数据和输出数据之间保持了这种自洽性。

这些模型既可以在蒸馏模式(distillation mode)下训练,也可以在分离模式(isolation mode)下训练。

在蒸馏模式中,模型能够从预训练的扩散模型中提取数据,使其能够在单个步骤中执行。

在分离模式下,模型完全不依赖于扩散模型,从而使其成为一种完全独立的模型。

值得注意的是,这两种训练方法都将「对抗训练」从中删除。

不得不承认,对抗训练确实会产生更强大的神经网络,但其过程是较为迂回。即它引入一组被错误分类的对抗性样本,然后用正确的标签重新训练目标神经网络。

因此,对抗训练这种方式也会导致深度学习模型预测的准确性略有下降,甚至它可能在机器人应用中带来意想不到的副作用。

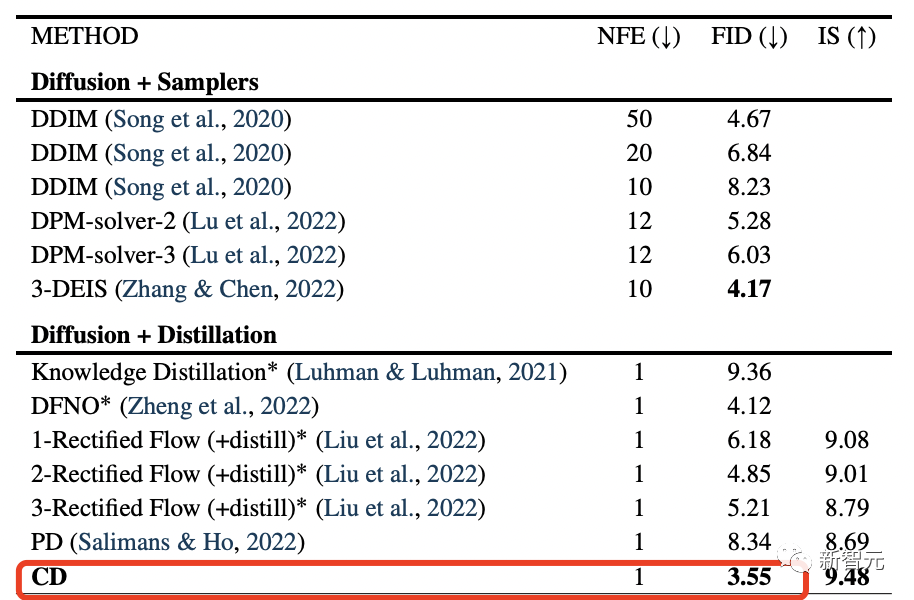

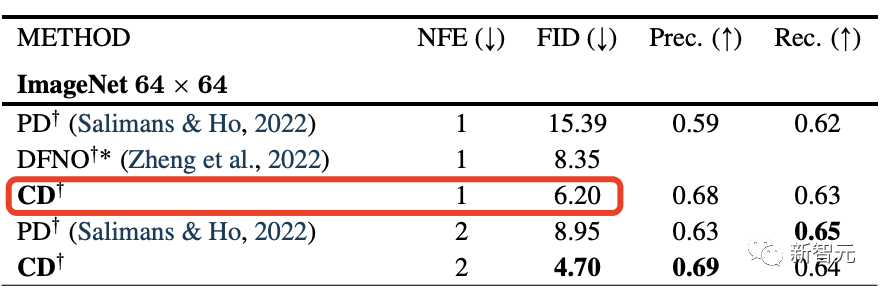

实验结果表明,用于训练「一致性模型」的蒸馏技术优于用于扩散模型的。

「一致性模型」在 CIFAR10图像集和 ImageNet 64x64数据集上,分别获得了3.55和6.20的最新最先进的FID分数。

这简直就是实现了,扩散模型的质量 + GAN的速度,双重完美。

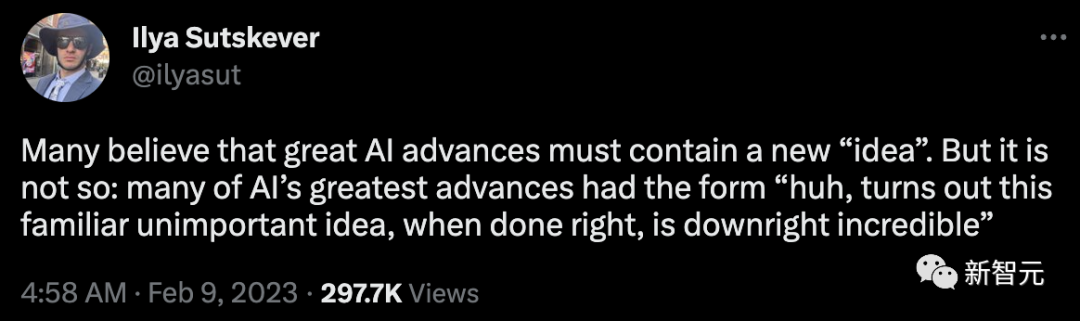

2月份,Sutskever曾发布了一条推文暗示,

许多人认为伟大的AI进步必须包含一个新的「想法」。但事实并非如此:许多AI的最伟大进步都是以这样的形式出现的,嗯,原来这个熟悉的不起眼的想法,如果做得好,会变得令人难以置信。

最新研究正好证明了这一点,基于旧概念的微调可以改变一切。

作为OpenAI的联合创始人兼首席科学家,Ilya Sutskever无须赘述,看看这张「顶级扛把子」大合照就够了。

(图片最右)

Yang Song(宋飏)

论文一作宋飏,是OpenAI的研究科学家。

此前,他在清华大学获得数学和物理学学士学位,并在斯坦福大学获得了计算机科学硕士和博士学位。此外,他还在谷歌大脑、Uber ATG和微软研究院做过实习。

作为一名机器学习的研究人员,他专注于开发可扩展的方法来建模、分析和生成复杂的高维数据。他的兴趣横跨多个领域,包括生成建模、表征学习、概率推理、人工智能安全和AI for science。

Mark Chen

Mark Chen是OpenAI多模态和前沿研究部门的负责人,同时也是美国计算机奥林匹克队的教练。

此前,他在麻省理工学院获得了数学与计算机科学学士学位,并曾在几家自营交易公司(包括Jane Street Capital)担任量化交易员。

加入OpenAI后,他带领团队开发了DALL-E 2,并将视觉引入到GPT-4中。此外,他还领导了Codex的开发,参与了GPT-3项目,并创建了Image GPT。

Prafulla Dhariwal

Prafulla Dhariwal是OpenAI的一名研究科学家,从事生成模型和无监督学习。在此之前,他是麻省理工学院的一名本科生,学习计算机、数学和物理学。

有趣的是,扩散模型可以在图像生成领域吊打GAN,正是他在2021年的NeurIPS论文中提出的。

网友:终于做了回Open AI

OpenAI今天开放了一致性模型源代码。

终于做回了Open AI。

面对每天太多疯狂突破和宣布。网友发问:我们是稍作休息,还是加速前进?

与扩散模型相比,这将大大节约研究人员训练模型的节约成本。

还有网友给出了「一致性模型」的未来用例:实时编辑、NeRF渲染、实时游戏渲染。

目前倒是没有demo演示,但值得确定的能够实现图像生成的速度大幅提升总是赢家。

我们直接从拨号升级到宽带了。

脑机接口,外加几乎实时生成的超逼真图像。

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK