Stability AI 创始人:大模型不应该只属于巨头

source link: https://www.geekpark.net/news/315882

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

Stability AI 创始人:大模型不应该只属于巨头

OpenAI 不够「Open」,Stability 确实很「稳」。

追溯 ChatGPT 引发的 AI 军备竞赛,可以回到去年 7 月,图像生成模型 Stability Diffusion 开源(下文称 SD)。这个在 Open AI 的绘画模型 DALL- E2 之后发布的模型,因其源代码开源,且对公众开放使用,在当时吸引了最多关注和讨论。(使用 DALL-E2 需要申请,通过率很低)

模型背后的公司 Stability AI 创始人 Emad Mostaque,一位在英国长大的印度裔,当时可能没有意识到,自己按下了 AI「重启」的加速键。

SD 的大热,影响了 Open AI 随后的决策:管理层决定推迟一直在研究的 GPT-4,快速上线普通用户可用,界面友好的 ChatGPT。

这带来了之后所有人都熟知的故事——ChatGPT 创下了 2 个月访问用户破亿的纪录,开启了微软和谷歌之间的巨头间之战,标志了 AI 大模型时代的来临。

前不久,马斯克批评 Open AI 背离了开源、非盈利的初衷,这也是 Open AI 一直以来的争议。关于如何管理和运作大模型,也是 Stability AI 与 Open AI 的关键区别之一。

Emad Mostaque 认为,大模型需要更多监督,而非在大公司内部运作,社区系统的开放性也至关重要。

他今年 39 岁,此前主要的职业生涯是一位对冲基金分析师,也是一位自闭症孩子父亲。他会一些 AI 技术,但是认为自己更常做的事是「机制设计」,将不同的模式的图景融合在一起。他不喜欢巨头控制流量算法的游戏规则——这背后是对人们的操纵,甚至找纪录片《社交困境》(The Social Dilemma)里的所有前员工们聊过天。

Emad Mostaque|来源:Stability AI

「作为一家企业,我们只是社区的一员」,公司的 CTO 在之前的 IF 2023 的分享中表示。Stability AI 也将坚持模型开源,让世界各地的人都能够触及最新的技术。

在支持开源社区上,Stability AI 前不久和 Hugging Face 等几个初创公司一起资助了研究社区 Eleuther AI。在 2022 年,Stability AI 曾为该组织捐赠过云计算资源。捐赠的资源来自另一家科技巨头亚马逊。

Stability AI 与其签订协议,获得了超过 4000 个英伟达 A100。在此之前,计算资源基本上来自创始人自套腰包购买的 32 个 GPU。

而据路透社报道,Stability AI 可能正在以 40 亿美元的估值寻求下一轮估值。上一轮融资后,公司以 10 亿美元估值成为新晋独角兽。

从已存在的收费模式来看,Stability AI 与 Open AI 基本类似,通过 API 收费,或者向个人用户收费提供增值服务。此外,Stability AI 将聚焦于创意产业,为内容生产公司定制专属模型。公司已经和印度的投资机构 Eros Investments(爱神投资)成立了合资企业,后者拥有 1.2 万部的电影资料库。

在巨头布局大模型的时代,Stability AI 的探索路径无疑值得关注。这篇文章是他去年 11 月和 10 月两次播客采访的整合编译,分别来自 Weight&Biases 和 Hard Fork。在创立 Stability AI 之前,他有AI 制药、科技公益等不同领域的经验,这无疑影响到他对技术该如何被创造、如何被使用的思考。

在新冠项目中

接触到大模型

我在牛津大学开始了数学和计算机科学的职业生涯。在 Gap Year 期间,我是一个企业开发人员。之后做了多年的对冲基金管理,我曾是 AI 和视频游戏的大型投资方。后来儿子被诊断出患有自闭症时,我休息了一下,用 AI 做药物发现。分析神经递质的生物分子通路,回顾文献,重新使用药物以帮助改善一些症状;我同时向一些对冲基金和其他政府提供关于 AI 和技术、地缘政治的建议等。

我大约是在 12 年前开始这段经历的。几年前,我是 CAIAC 的首席设计师之一,这个名为「集体和增强智能应对新冠肺炎」(Collective and Augmented Intelligence Against COVID-19)的项目于 2020 年 7 月在斯坦福大学启动,旨在获取世界上的冠状病毒疾病知识,利用 AI 对其进行压缩,使其变得有用。那是我第一次真正接触到这些新模型。

我当时就想,「天啊,这太重要了。它们正变得足够好、足够快,而且很快就变得足够便宜,可以抵达任何地方。」还有,「所有这些如此强大的技术都将被大公司所控制,而他们相信自己的优势就是如此,这合理吗?」不是,让我们向前走。

我有一些 AI 和其他方面的经验,不过大多数时候,我所做的是看到大的图景和模式,把它们放在一起,有点像机制设计。

Stability AI 的成立

三年前,我们就有了 Stability AI 的想法。我和联合创始人做的第一件事是参加了 Global XPRIZE for Learning(注:用科技手段帮助贫穷儿童学会读写、计算的公益项目),有 1500 万美元的奖金,奖励第一款可以在没有互联网条件下教读写和计算的应用程序。

我们把平板电脑部署到难民营,「如果我们用 AI 让它更好、更强大,会发生什么?」我们还没有使用 AI,但我们刚刚完成了随机对照试验,在 13 个月的教育中,每天教难民营中的难民一小时读写和计算。

在两年前,我们恰逢其时地建立了 Stability AI,来开展联合国支持的 AI 领域 2019 冠状病毒疾病工作,结果陷入了许多官僚主义和其它问题。

最初,我们帮助支持 Eleuther 和 LAION 等社区。我的想法是,这就像是 Web3 道琼斯指数。比如「让我们奖励所有的社区成员,让他们团结起来」。但是大约一个月之后,我们意识到商业开源软件的规模和服务才是解决问题的方法。

当我在资助整个开源艺术空间的时候,我认为至少在明年能接近现在看到的质量。我认为这是(由于)知识压缩的速度,使用的容易度,以及能够连接到一些人的设备。这让我很吃惊,我以为至少还要再过几年我们才能到达那里。

Stable Diffusion 是第一个足够好,足够快,足够便宜,任何人都可以运行的模型。这就像一个 2G 的文件,有来自 10 万 G 的数据。我觉得就是这个疯狂的东西让它大规模爆炸,这是主要的催化剂。

Stability 基本建立在这样一种信念之上,我们拥有的这些新模型——这些基于 Transformer 的模型、以及类似的模型——对于释放人类在我们所见过的某些最强大的技术中的潜力至关重要,将它们开源、以便人们可以在其基础上进行开发和使用,相信这不仅是一个伟大的商业模式,而且对于缩小数字鸿沟和尽可能推广这些技术至关重要。

Stability AI的官方使命是建立基础来激活人类的潜力,座右铭是「让人们更快乐」。我们基本上催化了开源 AI 模型的构建,然后我们采用这些模型,为客户扩展和定制它们。

Stability AI 可以开源大模型,

而 Big Tech 不能

我们有 100 名员工,社区有 10 万人。这就是我们力量的来源,我们来自世界各地。我们还给他们收入分成,这很奇怪。我们给他们好处,因为我们尝试把他们当作艺术家。

我和纪录片《社交困境》(《The Social Dilemma》)里的所有人聊过天。从大型科技公司的角度来看,大型科技公司之所以建造圆形监狱,是因为他们无能为力,他们别无选择。我们现在给了它一个选择。我们现在在和大型科技公司合作,给他们一个出口,让他们成为这件事的一部分。我们有点像瑞士,每个人都可以作为中立方参与进来。

尤其是工程师,想让事情变得自由和开放,但同时有监管,有信任和安全的部分。我们得到了关于这个问题的指导和意见,来找一个中庸之道,因为它不能是极端纯粹的自由主义,而另一个极端是没有人拥有任何东西。

The Social Dilemma 海报

我认为拥有的这些因素会帮助我们做到这一点。通过风险投资,我们按照自己的条件筹集资金,所以有完全的独立性。而不像 OpenAI,他们从微软那里筹集了 10 亿美元,而微软拥有技术的独家许可。不一致的激励是很难对抗的。我们希望社区、我们的团队和我们的位置能够帮助我们平衡这一点,对我们来说,处于这个位置是一件好事,没有其他人真正占据这个位置。

同样,我们正在与监管机构积极谈判。公众的角色是社区和延伸。所以我们释放了 Stability Diffusion,然后就有点疯狂了。1000 个项目如雨后春笋般出现。

社区就会说,stability AI 为什么不介入并协调,并有一个官方代言人? 我们说,好吧。所以我们进去了,把 Reddit 变成了官方的 Reddit。他们说,你怎么敢?(真是)公司霸主。

我们只是想让事情变得更有条理。然后我们不得不把它还回去。总是有这种推推搡搡的关系。我认为社区优先,但不能是直接民主。我们会犯错误,我们会做正确的事情,我们会受到越来越多的审查,因为我们所做的事情实际上是至关重要的。

大型科技公司处于不令人羡慕的位置,因为他们不能发布它来做公关。它就像来自神的普罗米修斯之火——这是下一代的交流,这是疯狂的——它可以用来烧毁东西。它可以用来激活人性之光。 但是我们寻找如何处理的唯一办法就是一起努力。这就是为什么我想要与大型科技公司合作,想要与小型科技公司合作,想要与监管机构合作,想要与每个人合作,试图找出正确的方法。

计算资源是公共利益

现在我们有很多控制权,因为我们是最快的计算机供应商。我们正在局部努力的就是让研究者能够使用自己的计算机,同时刺激一些国家集群更加开放。不再需要 6 到 12 个月来获得 A100 或 H100 访问权限。

我认为,它应该更加多样化一点。各方都在桌上,而不是集中。这是我们有意采取的行动,目的是从伦理和道德角度,逐步实现越来越多的分布式终端。从商业的角度来看,这对我们也有用。

如果我们被认为掌控了一切,我们就不知道那里会发生什么。协调整个社区需要付出很大的努力,但可能不会是积极的。假设如我们预期的那样,一亿、十亿人参与进来,协调所有部分需要很多工作。相反,它应该是一个独立的实体,所有的声音可以从那里被听见。

我们也有自己的角色。我们从计算机的主要提供者,变成了计算机的提供者。希望全世界所有计算机都能被提供出来,更高效地做这件事。因为这是一项公共利益(public good)。这对我们有好处,因为它节省了我们的成本,开源模型的创建不需要我们付出任何代价。

对我们来说,成为第一层基础设施层是有意义的,然后开始运作,建立一个业务模型来扩展它。

基于基础模型,

社区可以分叉

(团队分歧)发生在 Stable Diffusion 释放之后。人们说,「这可以用于不安全的工作,我们不觉得舒服,在 Stability 内部支持它。」

作为一个团队,我们进行了讨论,决定不再通过 Stability AI 发布任何工作起来不安全的模型。有些人对此很不满意。大多数人都能接受,但这更容易,因为这是一个团队的决定。

在社区的基础上,这属于治理结构。我们正在研究 EleutherAI,我们想把它转化成一个独立的社区,因为它有很多不同的实体和很多不同的观点。这是一个刚刚开始的治理结构。但是我们需要让它具有适应性,因为我们不确定这些东西会去哪里。

目前,Stability AI 对 GPU 访问、以及类似的资源有很大的控制。今后不应该出现这种情况,因为任何一个实体ーー无论是我们、 OpenAI、 DeepMind 还是其他实体ーー都不应该控制这项技术,因为这是共同利益。

我们想成为独立非盈利组织的贡献者,而不是控制这项技术,然后在支持和促进开源方面发挥作用。我认为最终会发生的是,如果人们真的不同意,他们就分叉。我们在各个社区都看到过。这就是开源的魅力所在。

你可以分叉模型。我认为关键是基准模型。这是个很大的前期计算,然后微调和运行需要相对较少的计算。这与 Google 或 Facebook 当前的模式正好相反,将其转化为数据库结构的计算相对较少,大部分计算都是在推理时完成的。这是整个范式的颠覆,但这不是社区分叉。

社区分叉是关于工作安全或不安全的分歧,如数据集、「爬虫或许可」或类似的东西。我想围绕着一些关键问题,会有不同的社区。

Stability AI 官网

防止巨头使用

大模型操纵人们

大型模才是问题所在。我们应该对此有更多的监督,以防某些 AI 组合的事物正确、却危险。

想象一下,苹果、亚马逊、谷歌将情感文本到语言(emotional text-to-speech)整合到他们的模型中。Siri 突然有了一个非常诱人的声音,并且悄悄告诉你应该买东西。你可能会买更多。这会受到监管吗?现在还没有,也不会及时。

将这些模型公之于众会让人们思考,「实际上,这可能是应该受到监管的东西。」如果有些东西是被规范的,那也没关系,因为这是一个民主的过程。

那些利用这种技术来操纵我们的公司ーー准确讲,就是广告模式ーー我认为这是不合适的。人们明白这项技术,意味着人们将更加挑剔的策划输出,然后它将是检测技术的混合产物。这是一个复杂的辩论,基本上不能在旧金山做出决定。这很重要,因为世界上不可避免地存在着技术。

如果你真的戳人,说「不想让印度人使用这项技术」,他们会说,「我们当然想!」「什么时候?」「当安全的时候」「谁决定的?」「我们做的」「所以他们不够聪明,不能做出决定?」「不,他们需要接受教育。」然后情况变得很糟糕,对吧?同样,我认为这是可以理解的,因为它既可怕又冷酷的。

Stability AI 的商业模式:

提供定制模型

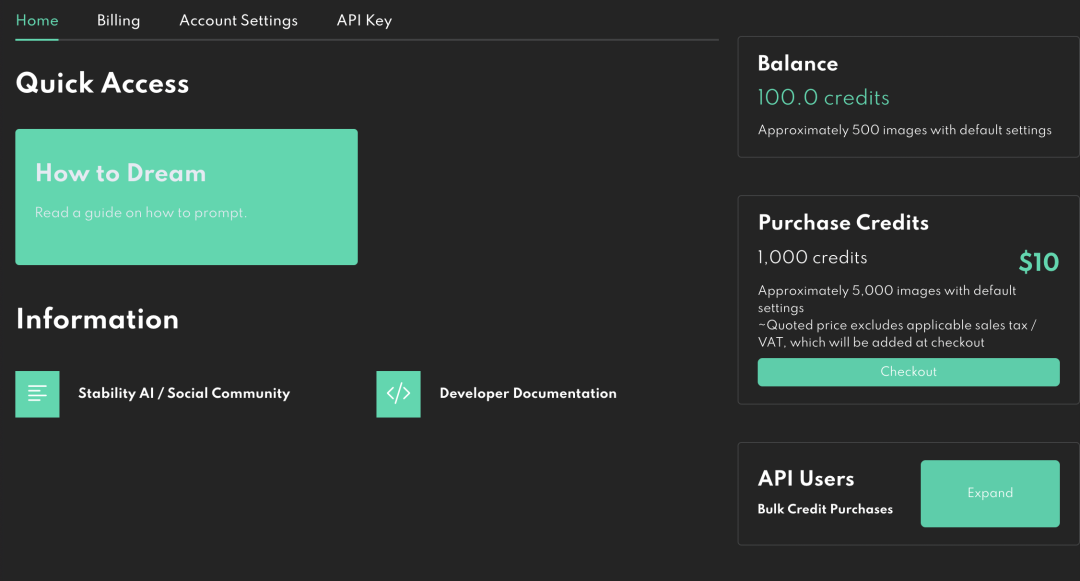

这些模型ーー以及它们运行所依赖的数据,几乎可以做任何事情。如果你将不同的玩家聚合起来,以实现质量,并且开源版本,价值在哪里呢?如果模型可以做任何事情,那么它的价值就不可能存在于模型中,价值肯定在别处。规模化可以让我做到这一点,我们有 API,以及 DreamStudio.AI,这是我们自己的执行版本。(注:DreamStudio 是一个让所有人直接使用 SD 模型的用户界面,前 500 张图像生成免费,后续可以充值)

(追问:所以每次有人通过你的 API 创建一个图像,你就能从中抽成?)是的,或者通过 Dream Studio,我们有不错的分成。第二部分是服务,很少有人能建立这些模型,但是世界上每个内容提供商都想拥有他们自己的模型版本。你想要一个 Hello Kitty 的模型,或者你想要一个宝莱坞的模型。

基本上其价值在于将 Hello Kitty 作为一项业务进入市场,并将其资产转化为互动资产。它可以用于元宇宙,可以用于新体验,也可以用于任何地方。然后开发工具,使他们能够访问自己的模型,让其他人能够访问自己的模型,并向世界各地输送这些工具。作为一个企业,我们的主要工作基本上是满足大公司的需求,然后通过我们开发的软件帮助其他人。比如 DreamStudio Lite 只是一个非常基本的软件。DreamStudio Pro 是一个功能齐全的动画套件,具有故事板、微调功能,以及创建自己的模型等功能。

DreamStudio AI 充值界面

我们会和大型内容库(合作)。我们称之为多元宇宙,因为我们认为每个人都应该有自己的模型。所以我们在那里嵌入团队,为他们创建模型,并分享好处。你有服务合同,所有这些合同都围绕着它,因为它们现在是一个专业化的事情。

我认为这就是可持续发展的优势所在:内容和经验的混合,以及内容。举个例子:我们和印度宝莱坞的 Eros(注:印度电影公司)做了笔交易,也就是印度的 Netflix,每天有 2 亿活跃用户。

你可以拥有丰富的生成式的未来,每个人都可以个性化和语境化这些东西。整个媒体空间都将是生成辅助的。我不认为它能取代,它增强了。从商业的角度来看,媒体是目前为止最有利可图的,它可以为很多其他的东西提供资金。

我认为这是一个合理的模式,迪斯尼和派拉蒙最终不得不改变他们的全部档案。就像 VHS 到 DVD 的提升一样,因为你知道做这些模型有多难。我们只是想,「什么可以是最有利于社区和吸引资产?」这就是媒体对我们的意义。

通过社区,去中心化决策

如果你是任何一个社区的活跃成员:从用于音乐的 Harmony AI,到用于语言模型的 Eleuther,再到用于图像的 LAION,你有很大几率用这种方式得到计算资源。可以是一个 A100 到 五百个 A100,取决于你的东西有多好,尤其如果你把社区的成员作为你的团队。这是最主要的方法。

我们正在建立一个拨款门户网站,正在与某些大学合作,也在理清应该怎样做,可能类似「Google Colab」(注:Google Research 提供的一项云服务,让任何人都可以通过浏览器编写和执行任意 Python 代码),允许人们从第一天开始解锁事情。

这也符合我们项目的下一阶段。我们资助了一些博士,他们是社区的活跃成员。我们计划 2023 年资助 100 位,还将为实验室和项目提供专用的计算支持。有一个独立的董事会负责做出决定,因为我们的业务和更广泛的业务之间总是存在矛盾。

我们为什么要资助 OpenBioML,(注:一个机器学习和生物学交叉的开放、合作研究实验室)因为它很有用。目前没有业务逻辑。我们希望保持支持整个生态系统的组合,这样我们在其中有一个很好的位置,然后关注一些商业方面的东西,目前是生成性媒体。

我们正在做的基本是,假设你创建了没有广告激励的 Facebook 和 Twitter,你也在加速使用工具来平衡这一点?

我们信任社区,信任这种去中心化,而不是集中化的协调,即这些决定是分开做出的。这些算法都被锁起来了,无法询问。它们是不可理解的。它并不完美,你可以质疑数据集,可以质疑模型,你可以质疑 Stable Diffusion 的代码以及其他事情。再次强调,我们相信这是一种公共利益和公共权利(public good and public right)。我们看到它一直在从偏见、信任和安全方面得到改善。在大公司里,动机不是公共利益。

我们想开放讨论。所以我们刚刚宣布了一个 20 万美元的奖金,奖励最好的开源 Deepfake 检测器。我们花了 10 倍于我们在图像生成模型上的算力,在图像识别模型上,它将被用来识别不良的,非法的和其他内容。所以这就是我们采取的方法,信任人们,信任社区,而不是让一个集中的、未经选举的实体控制世界上最强大的技术。

我相信这是表达自由的终极工具之一。我相信言论应该是自由的。我认为这就是力量所在。力量在于多样性。

技术的未来:

让人更好地表达和交流

对我们来说,最简单的沟通方式就是用语言交谈。接下来就是互相写邮件或聊天。要写出一篇真正优秀的作品是非常困难的。最困难的事情是作为一个物种进行视觉交流。这就是为什么艺术家是伟大的。我们都使用过幻灯片,也被困在那里。有了语言模型、视觉模型、语言生成模型和代码模型的组合,你就不再需要 PowerPoint 了。你每次都可以说话同时制作漂亮的幻灯片。

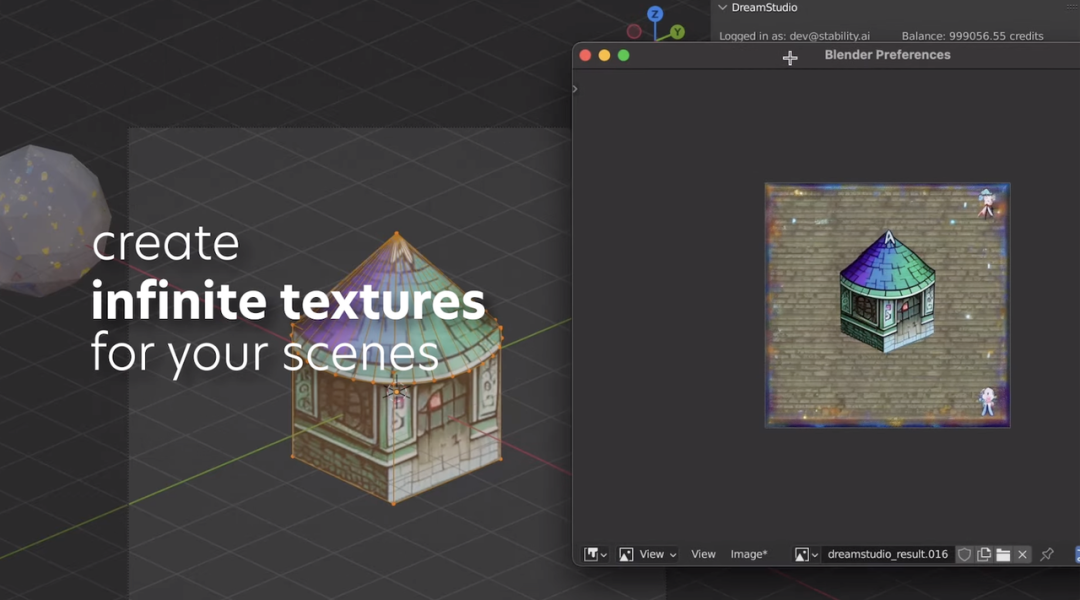

人类现在终于可以通过文本和语言模型进行交流了ーー你已经看到 Copy.ai、 Sudowwrite 和 Jasper 等软件是如何让这种交流变得更容易的ーー现在还可以通过视觉进行交流。下一步就是 3D。这是人类交流方式的一个巨大变化。

之前的网络迭代都是关于 AI 被用来定位广告。现在是关于别的东西,正在从消费转向创造。我的注意力一直集中在这个领域,作为主要驱动力。

就影响力和全球性事物而言,在人类水平上,结构化和非结构化数据化之间动态切换的能力,是一件非常重要的事。因为当它与检索增强、以及其他检查事实准确性的东西相结合时,能够理解原则,意味着你可以写报告,做法律事务,你可以摆脱官僚制度。

这是第一项能够实现这么多东西的技术,它是如此通用,以至于不确定它的价值在哪里。但是,我确实看到了任何人能够更好地表达自己和交流的价值。

Stability AI 发布的3D 生成软件 Blender|来源:公司官网

开放有危险,

但好处大于坏处

我们拥有许多工具,比如摄影和其他。如果你用 Photoshop 创建了一个受版权保护的实体,然后卖掉它,那是你的错。这些工具本身什么也做不了。你输入一个 2G 的文件,然后它创建一个输出。所以我们必须回溯到回最初的人类本性。

它现在所做的是打开了访问,就像印刷机打开了访问一样。现在任何人都有视觉创造力。就像我为七岁的女儿做的第一个版本,因为她说:爸爸,我想创作,这很有趣。这是绘画,看看你在做的所有东西。她创作了一件很棒的作品,叫做「快乐的年夜」,以 3500 美元的价格出售,作为印度 COVID 救济的 NFT,她把所有的钱都捐了出去。我心想,天哪,这可是件大事。我说,你为什么不多做点呢 ? 她又做了八件。她说,爸爸,一个人的独特价值只会随着行业的发展而上升。所以她打算支付自己的大学学费。

不管怎样,这项技术正在兴起。我们看到了这一点,于是说,好吧,我们有责任尽最大努力指导这件事,后让其他人进入这个房间。我认为,分开进行,你永远不知道会是什么样子。但是当有人打破时,他们可能会从不太好的角度打破它。我对此非常害怕。因为这项技术正被用于非常邪恶的方面。

然而我认为,好处远远超过坏处,因为没有什么比创造更重要的了。我们现在处于一个消费社会。如果你看看艺术疗法(art therapy)的作用,看看周围的事物,伴随着创造、以及人们使用这项技术而产生的快乐,我们为什么要把它与世界隔绝?谁是自认决定这一点?我认为这是错误的。这是对手段的封锁。

任何形式邪恶的可能性,意味着我们不能拥有任何东西。最好的是当我们一起变得更强大时,作为一个社群来打击邪恶,推动善良。

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK