隐私保护:AI实现医疗保健临床数据匿名化

source link: https://www.51cto.com/article/717863.html

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

隐私保护:AI实现医疗保健临床数据匿名化

面对突如其来的新冠疫情,我们已经亲眼见证创纪录级别的数据泄露事件。IBM最近的一份报告发现,数据泄露的成本也在急剧攀升。

医疗保健无疑是受数据泄露影响最大的行业之一,每起数据泄露事件平均造成920万美元损失。在此类违规案例当中,最常暴露在风险之下的信息类型正是敏感客户数据。

制药和医疗保健企业均需要在保护患者数据的前提下,按照严苛的指导要求组织运营。因此,任何违规行为都可能引发高昂代价。例如,在整个药物发现阶段,企业需要收集、处理和存储个人身份信息(PII),而在试验结束并提交临床申请时,必须在所公布的结果中注意保护患者隐私。

欧洲药品管理局(EMA)0070号法规和加拿大卫生部出台的《公开发布临床信息》规定,均对数据匿名化提出了具体建议,希望尽量降低利用结果还原患者身份信息的风险。

除了倡导数据隐私之外,这些法规还要求共享试验数据,确保社区能够以此为基础开展工作。但这无疑让企业陷入了两难境地。

所以,制药企业到底如何在数据隐私与透明度之间求取平衡,同时又能及时、经济且高效地发布研究结果?事实证明,AI技术能够承担起提交过程中超过97%的工作量,大大减轻企业的运营负担。

临床研究结果(CSR)匿名化为何如此困难?

在实施临床提交匿名化的过程中,企业主要面临三大核心挑战:

非结构化数据难于处理:临床试验数据当中,有很大一部分属于非结构化数据。研究结果中包含大量文本数据、扫描图片和表格,处理效率低下。研究报告动辄上千页,从其中识别出敏感信息就如同大海捞针。而且,没有任何标准化技术培训解决方案能够自动执行这类处理工作。

手动过程既繁琐又容易出错:如今,制药企业需要雇用数百名员工对临床研究提交进行匿名处理。整个团队需要经历超过25个复杂步骤,典型的摘要文档就可能需要长达45天的处理周期。而且在手动检查几千页材料时,枯燥的过程往往极易引发错误。

监管指南的开放性解释:虽然法规中提出不少详细建议,但细节仍然不够完备。例如,加拿大卫生部的《公开发布临床信息》规定就要求身份信息的还原风险应低于9%,却并没有详细介绍具体的风险计算方法。

下面,我们将从解决问题的角度,设想能够处理这类匿名化需求的具体方案。

利用增强分析识别人类语言中的敏感信息

以下三大要素,有助于建立技术驱动型的匿名化解决方案:

用于自然语言处理(NLP)的AI语言模型

如今,AI已经能够像艺术家那样创作,也能像医生那样诊断。深度学习技术已经推动AI取得诸多进步,而AI语言模型正是其中一股中坚力量。作为专司处理人类语言的算法分支,AI语言模型特别擅长检测命名实体,例如患者姓名、社保号码和邮政编码。

不知不觉当中,这些强大的AI模型已经渗透到公共领域的各个角落,并受到公开文档的规模化训练。除了知名的维基百科之外,包含40000名患者脱敏数据的MIMIC-III v1.4数据库也成为训练AI模型的宝贵资源。当然,为了提高模型性能,还需要由领域专家根据内部临床试验报告,对模型开展后续重新训练。

通过人机回圈设计提高准确率

加拿大卫生部提出的9%风险阈值标准,可以大致转化为95%左右的模型准确度要求(一般用召回率或精确度来衡量)。AI算法能够查看大量数据并运行多轮训练周期来提高自身准确度。然而,单靠技术改进还不足以为临床应用做好准备,这些模型还需要人的引导与支持。

为了解决临床试验数据的主观性并改善产出结果,分析解决方案在设计上要求与人类协同工作——这就是所谓增强智能。即将人类视为人机回圈中的一部分,他们不仅负责数据标记和模型训练,同时要在解决方案生效后定期提供反馈。通过这种方式,模型的准确度和产出性能都将有所提升。

以协同方式解决问题

我们假设某项研究共涉及1000名患者,其中980名来自美国本土,其余20人来自南美洲。那么,是否需要对这20位患者的数据进行编辑(涂黑)或匿名化处理?是否有必要在同一国家或洲内选择患者样本?攻击者可能会以哪些方式把这些匿名化信息同年龄、邮政编码等数据结合起来,最终还原患者身份?

很遗憾,这些问题并没有标准答案。为了更清楚地解释临床提交指南,制药商、临床研究组织(CRO)、技术解决方案供应商和学术界的研究人员需要联合起来、协同处理。

AI驱动的匿名化方法

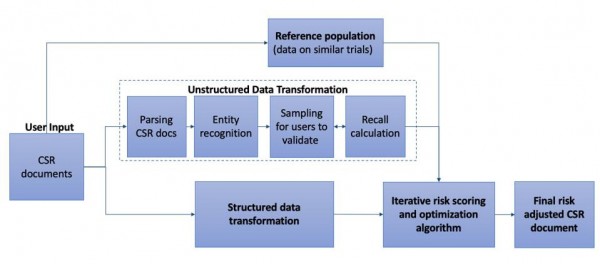

有了以上几条基本思路,接下来就是把它们拼凑成完整的解决方案流程。而整个匿名化方案中的各项技术,应当基于我们已经在工作中使用的实际方法。

临床研究报告中包含各种结构化数据(数字与身份实体,例如人口统计信息和地址条目),以及我们之前讨论过的各种非结构化数据元素。必须妥善处理,才能防止恶意黑客将这些内容还原为敏感的命名实体。结构化数据相对易于处理,但AI算法还需要攻克非结构化数据这道难关。

因此,首先使用光学字符识别(OCR)或计算机视觉等技术,将非结构化数据(通常为扫描图像或PDF等格式)转换为可读形式。之后,将AI算法应用于文档以检测个人身份信息。为了提升算法性能,用户可以分享对样本结果的反馈,帮助系统了解该如何处理这些置信度较低的分析内容。

AI驱动的匿名化方法

在匿名化完成之后,还须评估相应的身份还原风险。这项工作通常需要参考人群背景,再结合来自其他类似试验的数据来共同完成。风险评估会通过一组元素着重识别三大风险场景——检察官、记者和营销人员。这三群群体会从自身需求出发,尝试对患者信息加以还原。

在风险水平达到规定建议的9%之前,匿名化流程会持续引入更多业务规则和算法改进,尝试以重复循环的方式增强效能。再通过与其他技术应用的集成并建立机器学习运营(ML Ops)流程,整个匿名化方案就可以被纳入实际工作流当中。

比算法更艰难的挑战—数据质量

对制药企业来说,这样的匿名化解决方案能够将提交周期缩短达97%。更重要的是,这种半自动化工作流程既提高了效率,同时又保证有人类参与其中。但是,构建AI驱动型匿名化解决方案面临的最大挑战又是什么?

其实与大多数数据科学实践一样,这项工作的最大阻碍并不是用于识别命名实体的AI算法,而是如何将研究报告转换为可供AI处理的高质量数据。对于格式不同、样式和结构各异的文档,相应的内容摄取管道经常会无所适从。

因此,AI匿名化解决方案需要不断微调以适应新的文档编码格式,或者准确检测出图片/表格扫描件中的起始和结束位置。很明显,这方面工作才是AI匿名化当中最耗费时间和精力的领域。

临床研究的匿名化新挑战

随着技术的快速进步,临床研究的匿名化难度会不会持续降低、更加高效?虽然AI驱动型解决方案确实令人眼前一亮,但后续还将有新的挑战需要关注。

首先,通过社交媒体、设备使用情况和线上跟踪等方式收集到的消费者数据,正大大提升身份还原的风险。攻击者可以将这些公开信息同临床研究数据相结合,准确识别出患者的身份。更令人担忧的是,恶意黑客在AI成果的运用上非常积极,甚至有可能抢在制药企业的行动之前。

最后,法规也在持续演变,着力适应特定国家/地区的实践态势。也许很快就会有国家公布临床提交匿名化的具体法规,这必将增加企业保持合规的复杂性和成本负担。但所谓前途是光明的、道路是曲折的,AI技术的发展成熟至少为整个行业带来了攻克难题的希望曙光。

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK