朱松纯团队最新研究:机器人可与人类“推心置腹”!还说下一步要造“AI大白”

source link: https://www.51cto.com/article/714099.html

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

朱松纯团队最新研究:机器人可与人类“推心置腹”!还说下一步要造“AI大白”-51CTO.COM

本文经AI新媒体量子位(公众号ID:QbitAI)授权转载,转载请联系出处。

机器人能否像《超能陆战队》中的“大白”一样,理解人类情感和价值观,统一目标齐心协力解决问题?

现在,这个问题有了答案:

北京大学人工智能研究院朱松纯团队最新研究,提出一个可解释人工智能(XAI)系统,证明了机器人与人类真的能做到“推心置腹”,在工作中能像人类伙伴一样统一OKR。

也就是朱松纯团提出的实时双向人机价值对齐。

目前,朱松纯团队的这项研究成果,已经在顶级学术期刊 Science,及其子刊 Science Robotics上发表,而且都是头条位置。

人类与机器人,价值如何对齐?

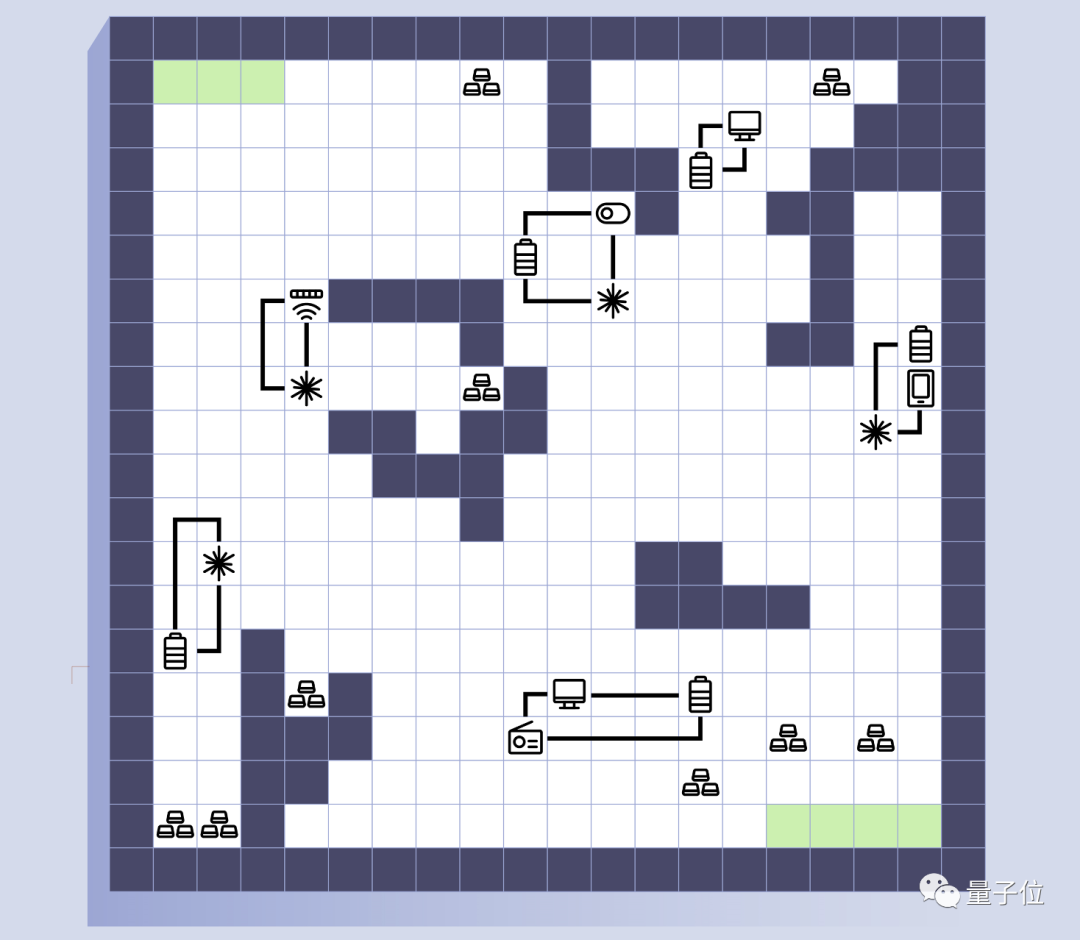

为了验证人类和机器人的价值能否对齐,朱松纯团队设计了一个需要人类和机器人共同协作完成任务的小游戏,由人类担任指挥官,率领3个机器人伙伴进行。

具体任务,就是在一个未知的20×20网格地图中,寻找一条从基地(位于地图的右下角)到目的地(位于地图的左上角)的安全路径。

需要注意的是,这张地图上的不同网格中,安放有不同装置,比如爆炸物,或者物资等等,只有当机器人靠近时才能显示。

除了寻找安全路径,在游戏开始之前,人类指挥官还会接到4个额外任务目标,指挥官需要4选1,任务包括:

- 尽快到达目的地;

- 调查地图上的可疑装置;

- 探索更大的区域;

收集资源。

这4个任务目标,代表的是人类指挥官的价值取向,而机器人需要人类指挥官不断进行任务反馈,进而理解指挥官的价值取向,自主行动。

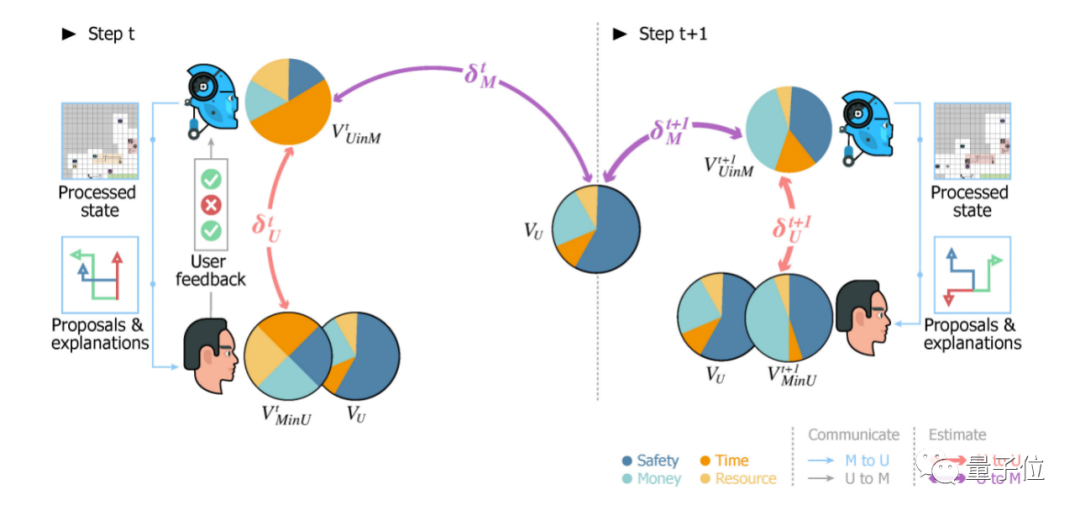

具体过程,就是人类和机器人关于价值目标一轮一轮的反馈和解释,最终趋向一致:

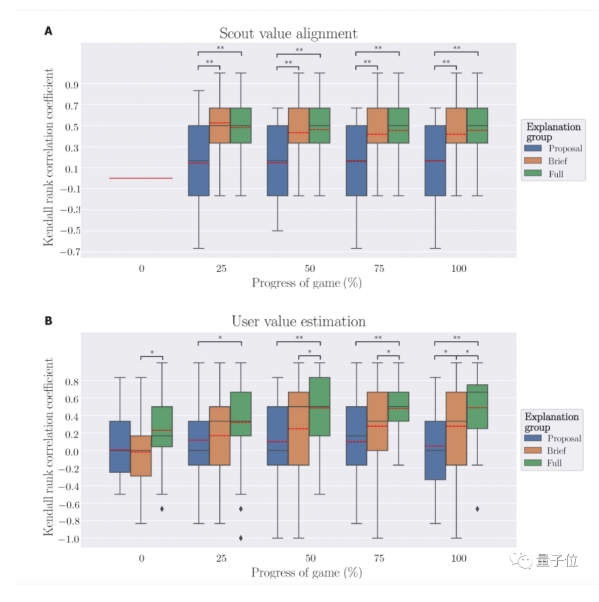

整个游戏分为3组,实验结果发现,机器人单方面接受人类指令,也就是单纯的作为倾听者时,在游戏进度达到25%时,通过对至少60%的目标重要性进行正确排序,快速与用户的价值进行对齐。

而作为表达者时,机器人向人类进行反馈,对遇到的状况提供完整解释时,在游戏进度50%的时候,实现了人类指挥官和机器人价值的统一。

机器人对遇到的状况仅仅是简要解释的话,需要在游戏进度达到75%的时候二者价值才能完成统一。

上面的实验结果,说明了人类与机器人协作过程中,双向价值对齐的过程:

首先,机器人通过接受人类的反馈,机器人可以逐渐更新自己的价值函数与人类的价值保持一致。

其次,在与机器人在不断的交互中,人类也逐渐形成对机器人能力和意图的感知,虽然二者的价值在游戏上半场没有实现统一,但从下半场的情况来看,人类对机器人价值评估能力的感知仍然可以提高。

最后,当机器人的价值选择变得稳定,用户对机器人的评估也稳定下来,从机器人对人类价值的评估到人类价值的真实值,以及从人类对机器人价值的评估到机器人当前价值的收敛配对,形成了基于人类真实价值取向的双向价值对齐。

结果摆在上面,而证明人类与机器人之间的价值双向对齐,需要一个理论,也是一切研究成果背后的原理:

可解释人工智能*(XAI)*,一种基于静态机器-动态人类的交流方式,解释人工智能每项决策背后逻辑的理论,学界此前多有研究。

朱松纯团队在实验游戏中的机器人系统,也是基于XAI,但不同之处在于,人类和机器人的交流方式发生了改变。

为了能使人与机器协作完成目标,需要一种人类价值主导的、动态机器-动态用户的交流模式。

在这种模式中,机器人除了向人类展示自己的决策过程外,还将根据用户的价值目标即时调整行为。

同时为了即时掌握用户信息,研究团队采用通讯学习取代了传统的数据驱动的机器学习方法,机器将根据所推断出的用户的价值目标进行合理解释。

这种合作导向的人机协作要求机器具有心智理论(ToM),即理解他人的心理状态(包括情绪、信仰、意图、欲望、假装与知识等)的能力。

这一点在多智能体和人机交互环境中尤为重要,因为机器只有在理解人类的状态和意图后才能更好地执行任务,其决策行为又会影响人类做出判断,从而形成一个以人类为中心、人机兼容的协作过程。

简单来说,采用上述方法进行人类和机器人的协同作业,可以同时赋予双方两个身份,倾听者&表达者。

这也就意味着,机器人至少在理论上,可以像你的人类团队伙伴一样,理解你的心思和价值取向,统一目标进行高效协同了。

论文作者介绍

朱松纯团队由UCLA袁路遥、高晓丰、北京通用人工智能研究院郑子隆、北京大学人工智能研究院朱毅鑫等人组成。

该团队长期从事可解释人工智能相关工作。此文是团队第二篇发表在 Science Robotics 的关于可解释人工智能的论文。

这项研究涵盖了认知推理、自然语言处理、机器学习、机器人学等多学科领域,是朱松纯教授团队交叉研究成果的集中体现。

朱松纯教授本人是人工智能领域全球著名的学者,曾任UCLA统计学系与计算机系教授,UCLA计算机视觉、认知、学习与自主机器人中心主任。

目前,朱松纯同时在清华大学和北京大学任讲席教授并担任管理职务。他主持的北京通用人工智能研究院(BIGAI)也是由清华大学、北京大学等单位合作支撑。

One More Thing

最后回到开头的那个问题,《超能陆战队》中的“大白”,真的能在现实中存在吗?

事实上,朱松纯团队已经在着手研究了。

据悉,目前朱松纯团队所在的北京通用人工智能研究院,联合北京大学人工智能研究院等单位,正在就人工智能的统一理论和认知架构进行研究。

未来的方向,就是打造具有自主感知、认知、决策、学习、执行和社会协作能力,符合人类情感、伦理与道德观念的通用智能体。

怎么样,你开心的时候能陪你开心,你悲伤的时候能为你拭去泪水,这样的机器人,要不要来一个?

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK