一些攻击算法

source link: https://yuanjie-ai.github.io/2021/09/22/some-attack-methods/

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

一些攻击算法

发表于

2021-09-22 更新于 2021-11-09

阅读次数:

1

本文字数:

628

阅读时长 ≈

1 分钟

又又又摸了几天,写了个爬虫,还是回来看论文了。整理一些常见的基于生成的攻击算法,之后再看一些较新的论文,就开始写自己的论文了,早日毕业吧。

Natural ADV

GENERATING NATURAL ADVERSARIAL EXAMPLES,发表在 ICLR 2018。众所周知,神经网络的输入层含有的信息和和隐层含有的信息是不同的,且常见攻击算法生成的对抗样本并不具有语义特征。所以这篇论文尝试生成 natural 的对抗样本。

与传统算法不同的是:传统算法在输入空间搜索对抗样本,而本文的算法尝试在隐空间进行搜索。即输入的为干净样本的分布 P(x),搜索一个 z⋆,并通过生成器将其映射回 x⋆,并期望对抗样本是合法且和原始输入较为接近。

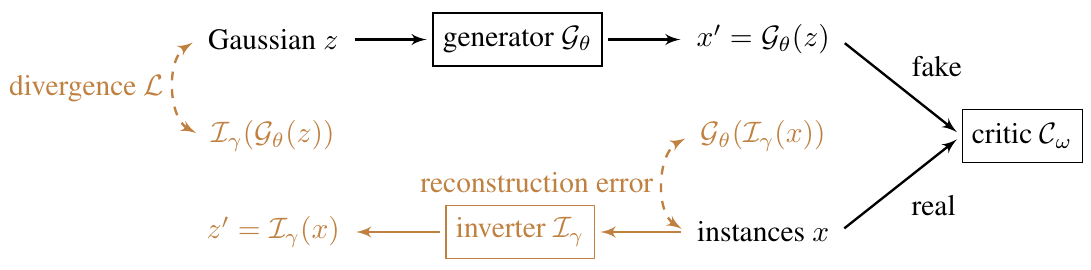

为了达到这个目标,作者选用 WGAN 作为生成器。首先训练一个 G,可以由 z 生成 x;同时训练一个与 G 相反的 I,由 x 生成 z。通过最小化重构 x 和 z 与 I(G(z)) 的误差作为损失函数训练模型。

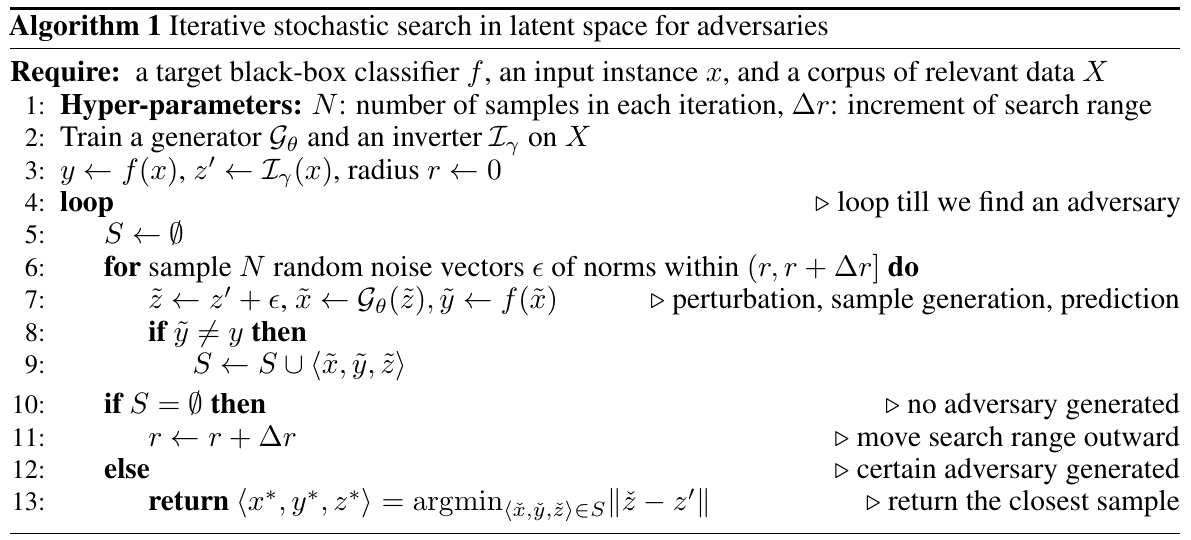

之后便是对抗样本的生成方法,使用生成器来判断当前的噪音是否能欺骗分类器,即在 f(G(z′))≠f(x) 的情况下,选择一个 z′,这个 z′ 和 I(x) 最为接近,那么对抗样本就是 x⋆=G(z′)。那么问题来了,如何搜索 z′ 呢?论文提出了两种搜索算法,都是直接在干净样本对应的隐向量 z 上增加扰动,如果扰动可以成功的攻击分类器,那么就认为搜索到了 z′。

欢迎订阅我的文章

Recommend

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK