B站修复动漫画质的模型开源了,超分辨率无杂线无伪影,还是二次元最懂二次元

source link: https://www.qbitai.com/2022/02/32397.html

Go to the source link to view the article. You can view the picture content, updated content and better typesetting reading experience. If the link is broken, please click the button below to view the snapshot at that time.

B站修复动漫画质的模型开源了,超分辨率无杂线无伪影,还是二次元最懂二次元

PK掉了9.2k星的RealESRGAN

丰色 发自 凹非寺

量子位 | 公众号 QbitAI

为了让你能高清重温童年的XXX,AI近来没少努力。

最近我们就发现了一个专为动漫图像而生的画质修复模型:

Real-CUGAN。

这个开源模型在今天登上了GitHub热榜,还来自b站官方。

它的效果也比此前俩个挺火的超分模型要更进一步,推理速度、兼容性什么的也都更快、更好。

“老二刺猿”了就是说。

结构魔改自Waiuf2x

Real-CUGAN,全名Real Cascade U-Nets for Anime Image Super Resolution。

其结构魔改自此前大火的图片无损放大/降噪神器——Waiuf2x (GitHub标星23k),并可以与之无缝兼容;训练代码基本来自腾讯去年刚出品的RealESRGAN (GitHub标星9.1k)。

Waiuf2x出自日本的一位“技术宅”,原理大概就是把一堆二次元图片缩小再和原图放一起,通过算法让模型自己学会了如何放大拉伸图片。

Waiuf2x有免费的网页版供大家使用。

RealESRGAN,主要通过模拟高分辨率图像变低分辩率过程中的各种“退化”过程,然后让模型看到一张糊图后倒推出来它的高清图。

它是对超分“前辈”ESRGAN的进一步改进,后者曾赢得ECCV2018 PIRM-SR挑战赛中的第一名。

相比这两位,Real-CUGAN都有什么独到之处呢?

首先在训练集方面,前两者都是采用私有二次元训练集,量级与质量未知,Real-CUGAN则用了百万级高清的二次元数据集。

在推理耗时方面(目标为1080P),如果以Waiuf2x为基线,RealESRGAN要耗费2.2x的时间,Real-CUGAN则只需1x。

在强度调整方面,Waiuf2x可以支持多种降噪强度,RealESRGAN没法调整,Real-CUGAN则支持4种降噪强度与保守修复,未来还会提供不同程序的去模糊、去JPEG伪影、锐化等功能。

此外,Waiuf2x只能实现1倍和2倍分辨率修复,RealESRGAN只支持4倍,Real-CUGAN则2~4倍都可以(1倍还在训练中)。

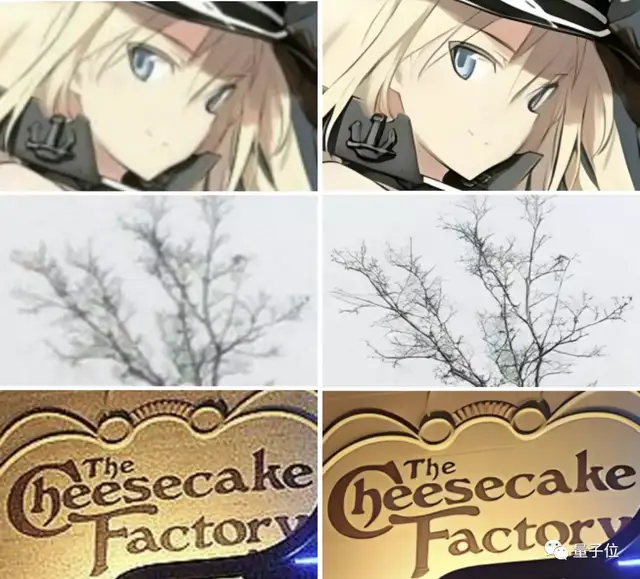

当然,最最最重要的还是效果。

来看一些最直观的对比图:

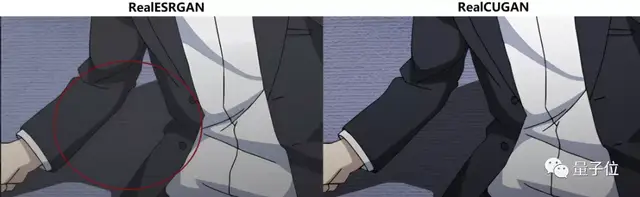

可以看到,Real-CUGAN和Waiuf2x的结果都差不多,但是RealESRGAN却没有处理好地板纹理。

在这组对比图中,Waiuf2x明显不如后两者线条清晰,而相比Real-CUGAN,RealESRGAN中人物嘴巴和下颚处的线条是虚的,有杂线。

而在这组“极致渣清型”图片的超分效果中,Waiuf2x仍然明显不够清晰。

而RealESRGAN整体清晰是清晰,却仍然出现了杂线,以及和明显的伪影——只有Real-CUGAN画面干干净净,表现最好。

面向4类玩家提供不同参数配置

为了方便更多的创造者,Real-CUGAN面向4类群体开源了不同的推理参数设置。

- Windows 玩家

Real-CUGAN为Windows用户打包了一个可执行环境(下载链接可在文末的仓库里自取)。

通过congfig文件可进行通用参数设置:在mode中填写video或者image决定超视频还是超图像。

模型分三类,具体选哪种也给了参考:

- Waifu2x-caffe玩家

提供了两套参数:Real-CUGAN2x标准版(denoise-level3) 和Real-CUGAN2x无切割线版。

- Python玩家

需torch>=1.0.0,配备numpy、opencv-python、moviepy模块。

- VapourSynth玩家(专业视频压制)

这个就不细说了,相应的读者可以参见仓库的Readme说明~

最后,Real-CUGAN也正在计划更新更多:包括快速模型、简单的GUI、一步超到任意指定分辨率功能以及对本身效果的改进(优化纹理保留,削减模型处理痕迹)。

心动的朋友可以戳下方链接试试手:

https://github.com/bilibili/ailab/tree/main/Real-CUGAN

Recommend

-

68

68

-

55

55

我爱计算机视觉 标星,更快获取CVML新技术 这是一篇来自小米的最新出炉的论文,使用神经架构搜索技术自动确定超分辨率网络模型,取得了又快又好的效果,模型已开源,非常赞!

-

54

54

-

33

33

近日,来自苏黎世联邦理工学院计算机视觉实验室的研究者提出了一种超分辨率模型 SRFlow。该模型具备比 GAN 更强的脑补能力,能够根据低分辨率输入学习输出的条件分布。该论文已被 ECCV 2020 收录。 超分辨率是一个不适定问题(il...

-

5

5

论文推荐 | 新超分辨率模型 SRFlow、缩小高性能计算和机器学习之间的差距的伯克利论文; 7个月前...

-

3

3

1.5K star量,上古老番变4K,B站开源超分辨率算法-51CTO.COM 1.5K star量,上古老番变4K,B站开源超分辨率算法 作者:机器之心 2022-02-15 15:48:03 最近,GitHub 上一个图像超分辨率的项目火了,...

-

5

5

AMD:不用AI也能超分辨率,支持N卡和Xbox,游戏画质帧率可兼得

-

5

5

扩散+超分辨率模型强强联合,谷歌图像生成器Imagen背后的技术-51CTO.COM 扩散+超分辨率模型强强联合,谷歌图像生成器Imagen背后的技术 作者:机器之心编译 2022-07-12 14:50:03 本文...

-

6

6

英伟达「一句话生成3D模型」碾压谷歌:分辨率清晰8倍,速度快2倍,编辑文本还可直接修改

-

2

2

阿里云窄带高清本质上是一种转码质量优化技术,是一套以人眼的主观感受最优为基准的视频编码技术,研究的是在带宽受限的情况下,如何追求最佳的视觉感受,即人眼感受的主观质量最优。而画面质量提升则是通过使用恰当的画质增强技术以达到。 我们先来看两个窄...

About Joyk

Aggregate valuable and interesting links.

Joyk means Joy of geeK